- Published on

Decoupled DiLoCo: Google DeepMind가 "거대한 단일 클러스터" 대신 고장에 강한 학습 섬으로 가는 이유

- Authors

- Name

- Kyunghyun Park

- @devkhpark

Google DeepMind · Decoupled DiLoCo · Distributed Training · Gemma 4

Google DeepMind가 4월 23일 공개한 Decoupled DiLoCo는 얼핏 보면 또 하나의 분산 학습 최적화 논문처럼 보일 수 있다. 하지만 실제 메시지는 그보다 훨씬 크다. 프론티어 모델 학습은 이제 "더 큰 한 덩어리 클러스터"를 만드는 문제보다, 고장과 지연이 일상인 환경에서도 학습을 멈추지 않는 구조를 만드는 문제로 이동하고 있다.

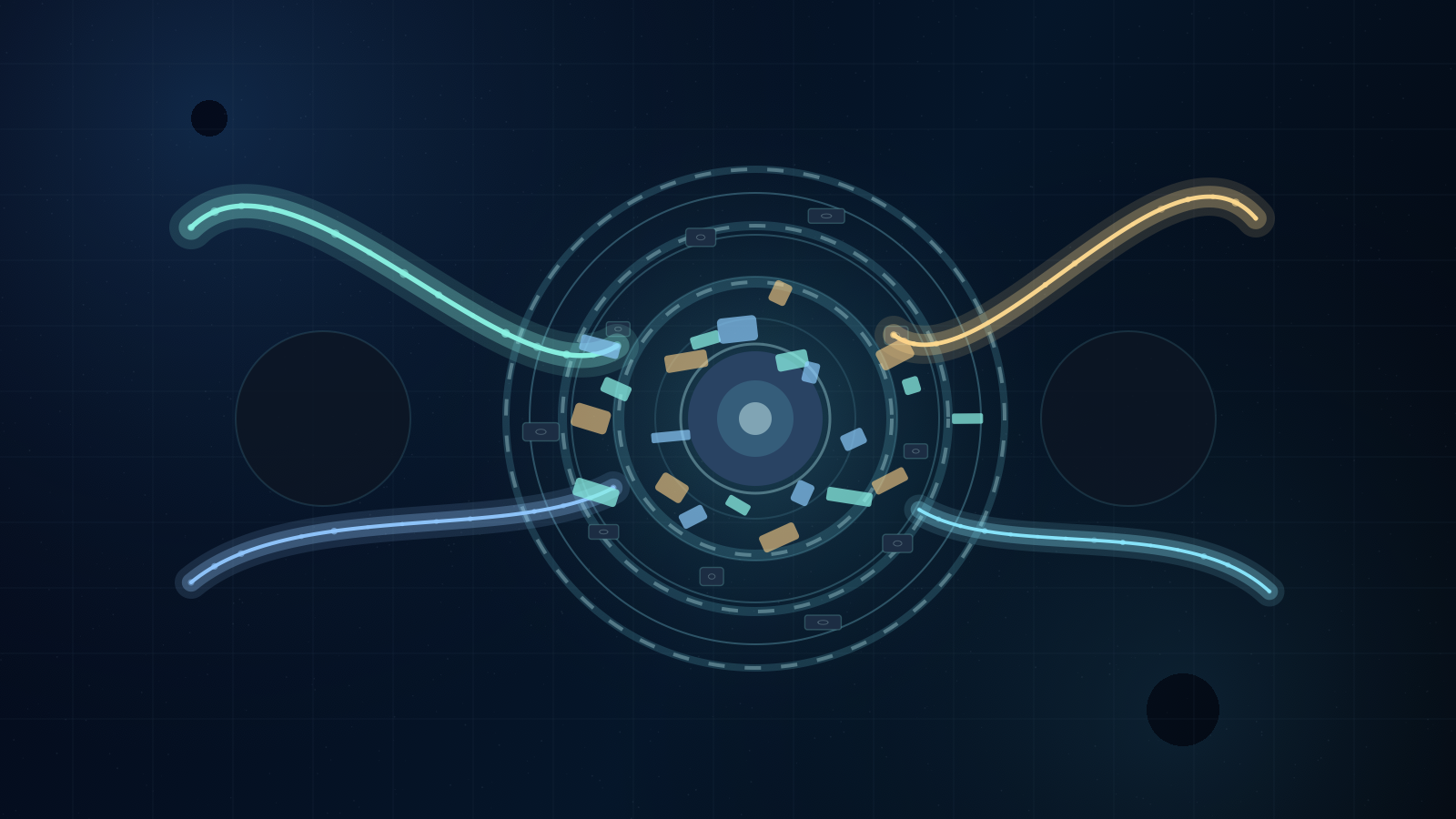

이게 중요한 이유는 단순하다. 지금까지 대규모 LLM 학습은 사실상 SPMD(single program, multiple data)와 강한 동기화에 기대 왔다. 칩 수가 많아질수록, 데이터센터가 멀어질수록, 그리고 장애 가능성이 높아질수록 이 방식은 점점 더 비싸고 취약해진다. Decoupled DiLoCo는 바로 이 병목을 정면으로 건드린다. 학습을 여러 개의 learner island로 쪼개고, 이들이 비동기적으로 파라미터 조각을 중앙 synchronizer에 보내도록 바꾸면서, 일부가 느려지거나 죽어도 전체가 멈추지 않게 하겠다는 접근이다.

이 글은 Google DeepMind의 공식 블로그, 새 논문 Decoupled DiLoCo for Resilient Distributed Pre-training, 그리고 기반이 된 DiLoCo: Distributed Low-Communication Training of Language Models를 바탕으로, 왜 이번 발표가 단순한 학술 뉴스가 아니라 AI 인프라 운영 전략의 변화 신호인지 정리한다.

한 줄 논지: Decoupled DiLoCo의 본질은 "학습 속도 약간 개선"이 아니라, 장애와 거리 때문에 전체 훈련이 멈추는 시대를 끝내려는 시도다.

이번 발표의 핵심은 "더 빠른 학습"보다 "멈추지 않는 학습"이다

전통적인 대규모 학습 방식은 강력하다. 하지만 그 대가가 있다. 수천, 수만 개 가속기가 거의 같은 리듬으로 움직여야 하고, 한쪽에서 느려지거나 고장 나면 나머지도 기다려야 한다. 논문 초록이 직접 말하듯, 기존 SPMD 구조에서는 transient slowdowns, hardware failures, synchronization overhead가 전체 계산을 멈추게 만들고 대규모 compute time을 낭비한다.

DeepMind가 이번 글에서 강조하는 것도 바로 이 지점이다. Decoupled DiLoCo는 학습을 여러 개의 독립 learner로 나누고, 각 learner가 로컬 최적화를 수행한 뒤 결과 조각을 중앙에 비동기적으로 전달한다. 즉 전체가 한 박자로 완전히 묶여 있지 않아도 된다.

이건 생각보다 큰 철학 변화다.

- 예전 질문: 어떻게 더 큰 하나의 클러스터를 만들까?

- 이번 질문: 고장이 나도 전체가 계속 학습하게 만들 수 있을까?

프론티어 AI 인프라가 어느 정도 규모를 넘어서면, 성능 최적화보다 운영 복원력이 더 중요한 문제가 된다. Decoupled DiLoCo는 그 현실을 논문 제목부터 인정하고 있다. 이름에 resilient가 들어간 이유가 괜히 있는 게 아니다.

DiLoCo에서 Decoupled DiLoCo로: 저통신 분산에서 비동기 복원력으로 넘어갔다

이전의 DiLoCo 논문은 이미 꽤 중요한 신호를 줬다. 언어 모델을 여러 개의 느슨하게 연결된 "device island"에서 학습할 수 있고, 8개 워커 환경에서 완전 동기식 최적화와 비슷한 성능을 내면서도 통신량을 500배 줄일 수 있다는 이야기였다.

하지만 DiLoCo에도 한계는 있었다. 통신량은 줄였지만 구조 자체는 여전히 근본적으로 동기식이었다. 즉 대규모 실환경에서 가장 골치 아픈 문제, straggler와 failure 때문에 전체가 멈추는 문제를 완전히 떼어내진 못했다.

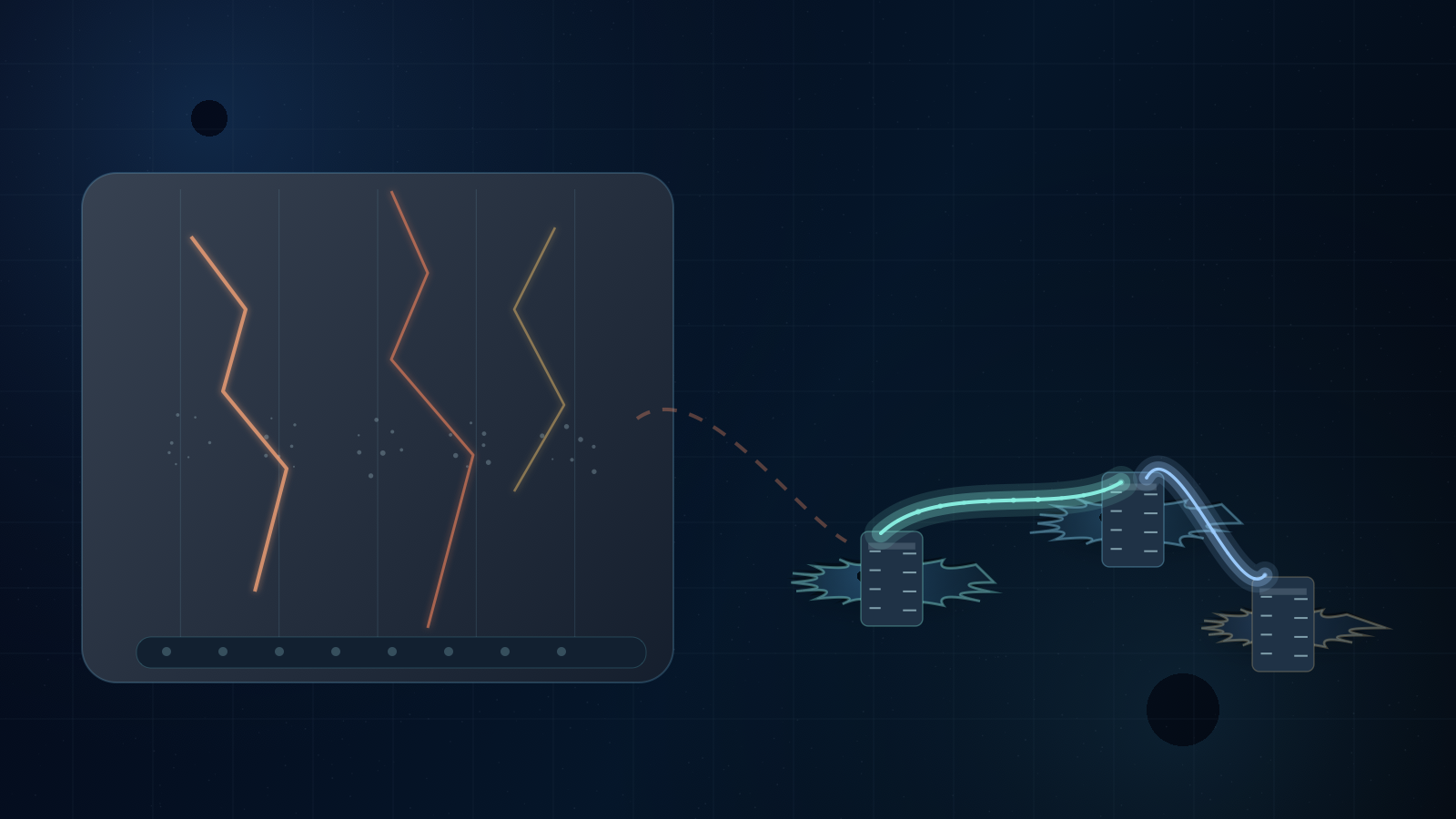

새 논문은 여기서 한 단계 더 간다. 초록 기준으로 핵심 메커니즘은 세 가지다.

multiple independent learners

- 여러 학습 단위를 독립적으로 굴린다.

- 각 learner는 로컬 inner optimization step을 수행한다.

central synchronizer

- learner들이 보낸 parameter fragment를 중앙에서 모은다.

- 여기서 전체 모델 업데이트를 조정한다.

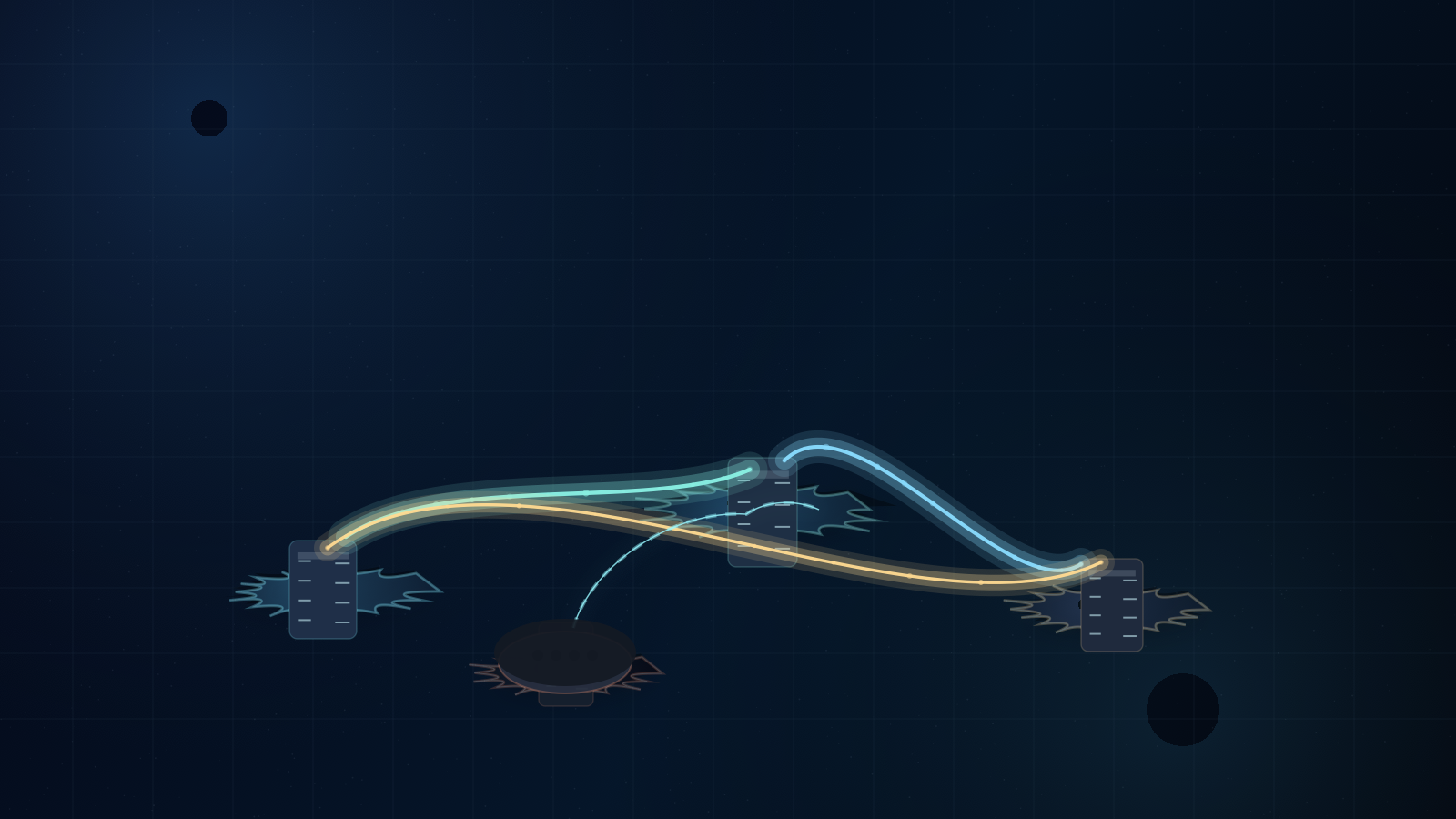

minimum quorum + adaptive grace window + dynamic token-weighted merging

- 모두가 도착할 때까지 무한정 기다리지 않는다.

- 일정 quorum만 확보되면 계속 진행한다.

- 느리거나 죽은 learner를 우회하면서 업데이트를 병합한다.

이 조합이 의미하는 바는 분명하다. 완벽한 동기화보다 유용한 진행률(goodput)을 우선하겠다는 것이다. 프론티어 모델 학습이 이제 이론적으로 가장 예쁜 스케줄보다, 실제 운영 환경에서 계속 전진하는 구조를 더 중요하게 본다는 뜻이기도 하다.

숫자로 보면 왜 중요한지가 더 선명하다: bandwidth보다 goodput가 본론이다

DeepMind 블로그가 공개한 수치는 꽤 상징적이다.

- 8개 데이터센터 기준 요구 대역폭: 기존 Data-Parallel 198 Gbps → DiLoCo 계열 0.84 Gbps

- 고장 많은 120만 칩 시뮬레이션 goodput: Decoupled DiLoCo 88% vs 표준 Data-Parallel 27%

- Gemma 4 기반 ML benchmark 평균 정확도: Decoupled DiLoCo 64.1% vs 기존 방식 64.4%

이 수치를 보는 포인트는 단순히 "대역폭을 아꼈다"가 아니다.

첫째, 대규모 분산 학습의 병목이 통신비 자체에서 운영 중단 리스크로 이동했다는 점이다. 198 Gbps를 0.84 Gbps로 줄였다는 건 물론 크다. 하지만 더 큰 메시지는 120만 칩급 고장 환경에서 goodput가 27%에서 88%로 유지된다는 부분이다. 실전에서는 평균 속도보다 멈추지 않는 비율이 더 중요하다.

둘째, 복원력을 얻으면서도 모델 품질을 거의 잃지 않았다는 점이다. 블로그는 Gemma 4 모델 테스트에서 benchmarked ML performance가 기존 방식과 사실상 같았다고 설명한다. 즉 이번 발표는 "고장엔 강하지만 성능은 많이 희생하는 백업 모드"가 아니다.

셋째, 이 결과는 단일 아키텍처 전용이 아니라 dense와 MoE, text와 vision task 전반을 겨냥한다는 점에서 의미가 있다. 논문 초록도 이 범용성을 강조한다. 특정 논문 데모용 기법보다 인프라 패턴으로 읽어야 하는 이유다.

진짜 의미는 데이터센터를 더 멀리, 더 이질적으로 묶을 수 있다는 데 있다

이번 발표에서 가장 실무적인 해석은 여기다. Decoupled DiLoCo는 단지 "칩이 고장 나도 괜찮다"가 아니라, 앞으로는 학습 클러스터를 반드시 한 장소, 한 상태, 한 리듬으로 유지하지 않아도 될 수 있다는 가능성을 보여 준다.

이건 여러 층위에서 중요하다.

1) 프론티어 랩 입장

최첨단 학습은 점점 더 많은 전력, 냉각, 네트워크, 공급망 제약을 받는다. 이런 상황에서 완벽하게 같은 가속기를 같은 장소에 계속 확보하는 건 갈수록 비현실적이다. 그러니 다음 경쟁력은 더 큰 슈퍼클러스터 한 개를 만드는 능력보다, 멀리 떨어진 여러 학습 섬을 하나의 지속 가능한 시스템으로 엮는 능력이 될 수 있다.

2) 클라우드/인프라 사업자 입장

학습 워크로드가 반드시 가장 빠른 내부 패브릭 위에서만 돌아가야 한다는 전제가 약해지면, 클라우드의 경쟁 포인트도 달라진다. 이제는 최고급 interconnect 하나보다도, 장애 격리·재조인·스케줄링·동적 병합을 얼마나 잘 제품화하느냐가 더 중요해진다.

3) 엔터프라이즈·국가 단위 운영 입장

규제, 데이터 주권, 전력 사정, 가용 리전 분산 때문에 학습 리소스를 한 군데로 몰기 어려운 경우가 많다. Decoupled DiLoCo류 접근은 이런 현실에서 꽤 매력적이다. 성능의 절대 최적값보다 운영 지속성이 중요할 때 특히 그렇다.

DeepMind가 블로그에서 chaos engineering을 직접 꺼낸 것도 흥미롭다. 이제 분산 학습 연구가 단순 최적화 알고리즘을 넘어서, 사이트 신뢰성 엔지니어링(SRE) 문법을 진지하게 받아들이기 시작했다는 뜻이기 때문이다. 고장을 "예외"가 아니라 "전제"로 본다. 이 관점이 중요하다.

한국의 개발자와 AI 인프라 운영자가 읽어야 할 포인트

국내에서 이 발표를 바로 따라 해서 100만 칩 학습을 돌릴 일은 많지 않다. 그래도 시사점은 분명하다.

모델을 직접 학습하는 팀이라면

- 단일 거대 클러스터 집착이 반드시 정답은 아니다.

- interconnect 스펙 경쟁만 보지 말고 장애 시 goodput을 봐야 한다.

- 멀티사이트 학습이나 이질 자원 재활용 가능성이 더 현실적인 전략이 될 수 있다.

파인튜닝/후학습 파이프라인을 운영하는 팀이라면

- 학습 파이프라인을 "정지 없는 운영" 기준으로 다시 봐야 한다.

- 느린 워커 하나가 전체를 붙잡는 구조는 생각보다 비싸다.

- quorum 기반 진행과 재조인 설계는 대규모 RL/후학습에도 응용 가능한 발상이다.

AI 인프라를 서비스로 파는 쪽이라면

- 앞으로 고객이 원하는 건 FLOPS 숫자만이 아니다.

- 장애 중에도 얼마나 계속 학습이 진행되는지, 어느 수준까지 품질을 유지하는지가 상품성이 된다.

- 학습 인프라의 차별점이 네트워크 스펙표보다 운영 소프트웨어 계층으로 올라갈 가능성이 높다.

요컨대 이번 논문은 연구자만의 뉴스가 아니다. 대형 모델 학습이 점점 더 "분산 시스템"의 문제로 되돌아가고 있다는 신호다.

한 줄 결론

Decoupled DiLoCo는 LLM 학습을 더 빠르게 만드는 작은 개선이라기보다, 프론티어 학습을 하나의 완벽한 거대 기계가 아니라 고장에 강한 여러 학습 섬의 네트워크로 재정의하려는 시도에 가깝다. 이제 경쟁은 누가 더 큰 클러스터를 갖고 있느냐만이 아니라, 누가 더 멀리 떨어진 자원과 더 많은 고장을 견디면서도 학습을 계속 밀어붙일 수 있느냐로 이동하고 있다.