- Published on

GitHub Trending에 오른 whichllm은 로컬 LLM 선택 문제를 모델 순위표가 아니라 현재 하드웨어, VRAM, 양자화, 토큰 속도, 최신 벤치마크 증거를 합친 운영 문제로 다시 정의한다. 한국 개발팀이 로컬 모델을 도입할 때 봐야 할 기준을 정리했다.

What I learned, What I did, What I thought

GitHub Trending에 오른 whichllm은 로컬 LLM 선택 문제를 모델 순위표가 아니라 현재 하드웨어, VRAM, 양자화, 토큰 속도, 최신 벤치마크 증거를 합친 운영 문제로 다시 정의한다. 한국 개발팀이 로컬 모델을 도입할 때 봐야 할 기준을 정리했다.

Roboflow Supervision이 GitHub Trending에서 다시 강하게 떠오른 이유는 단순한 CV 유틸리티 인기가 아니다. 모델 출력 이후의 주석, 추적, 구역 카운팅, 데이터셋 처리, 평가를 하나의 재사용 가능한 운영 계층으로 묶는 흐름이 컴퓨터 비전 제품화의 핵심 병목이 됐다는 신호다.

Microsoft pg_durable은 Postgres 안에서 장기 실행 SQL 워크플로를 정의하고 체크포인트·재시작·재시도·병렬 실행을 다루려는 확장이다. AI embedding, 문서 ingest, 외부 API 호출, 운영 runbook처럼 상태가 데이터베이스에 붙어 있는 작업에서 왜 이 접근이 중요한지 정리한다.

Microsoft VibeVoice ASR은 단순한 음성 인식 모델이 아니라, 긴 회의·강의·콜 로그를 speaker, timestamp, transcript 구조로 한 번에 처리하려는 오픈소스 음성 런타임이다. 60분 single-pass, 50개 이상 언어, hotword, Transformers/vLLM 배포, LoRA 파인튜닝이 왜 개발자에게 중요한지 정리한다.

OpenAI의 openai/plugins 저장소는 단순 예제 모음이 아니다. .codex-plugin/plugin.json, skills, MCP, app manifest, marketplace 정책을 한 번에 묶으면서 에이전트 기능을 설치·인증·버전 관리 가능한 공급망으로 바꾸려는 신호다.

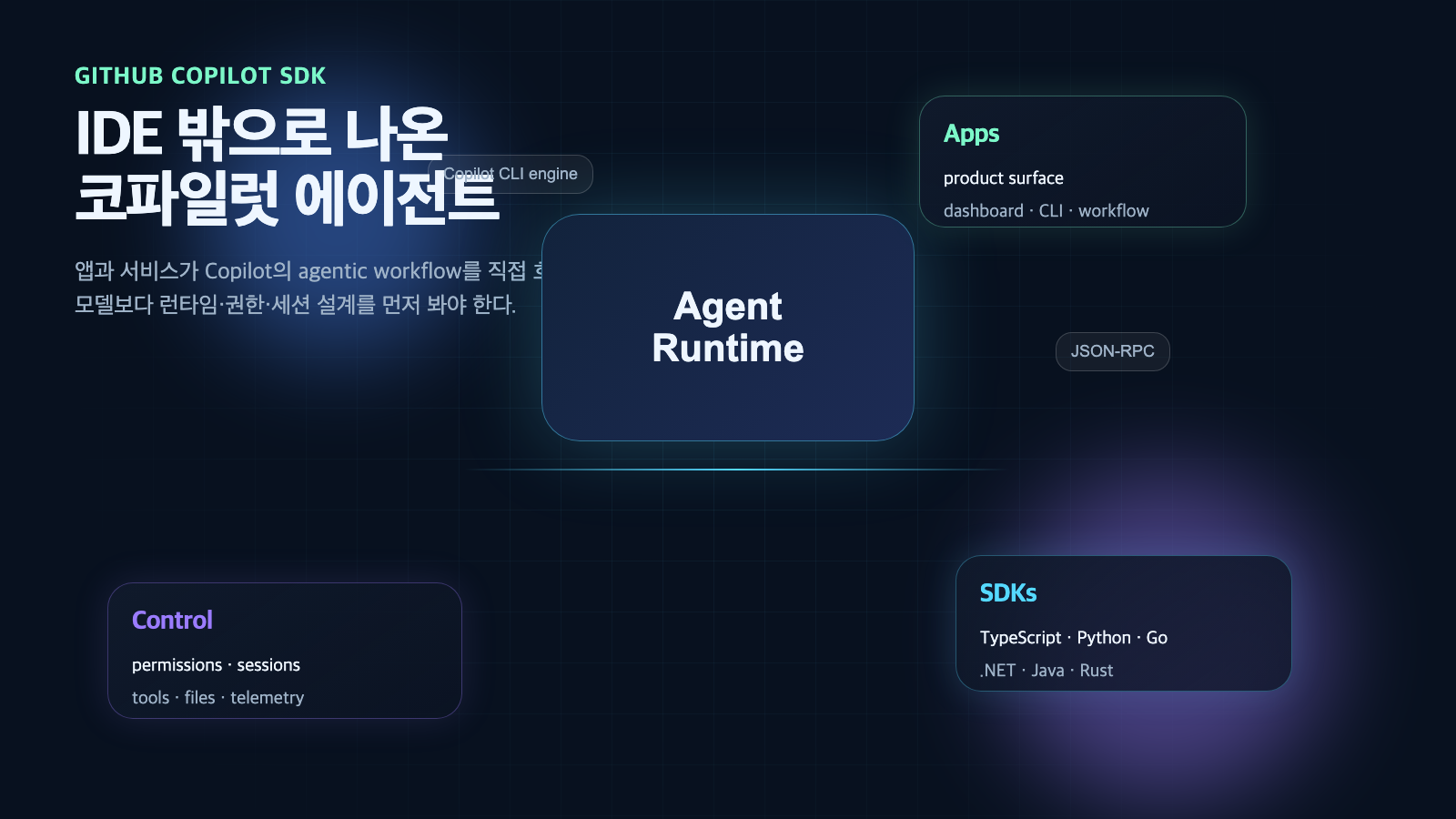

GitHub Copilot SDK는 Copilot을 IDE 기능이 아니라 앱과 서비스에 삽입 가능한 에이전트 런타임으로 바꾼다. TypeScript, Python, Go, .NET, Java, Rust SDK가 의미하는 것은 더 많은 언어 지원이 아니라 제품 안에서 planning, tool invocation, file edit, session control을 운영 계층으로 다뤄야 한다는 신호다.