- Published on

AWS AI-DLC: 코딩 에이전트를 “채팅 도구”가 아니라 개발 생애주기로 다루려는 시도

- Authors

- Name

- Kyunghyun Park

- @devkhpark

AI-DLC · 코딩 에이전트 · 개발 생애주기 운영화

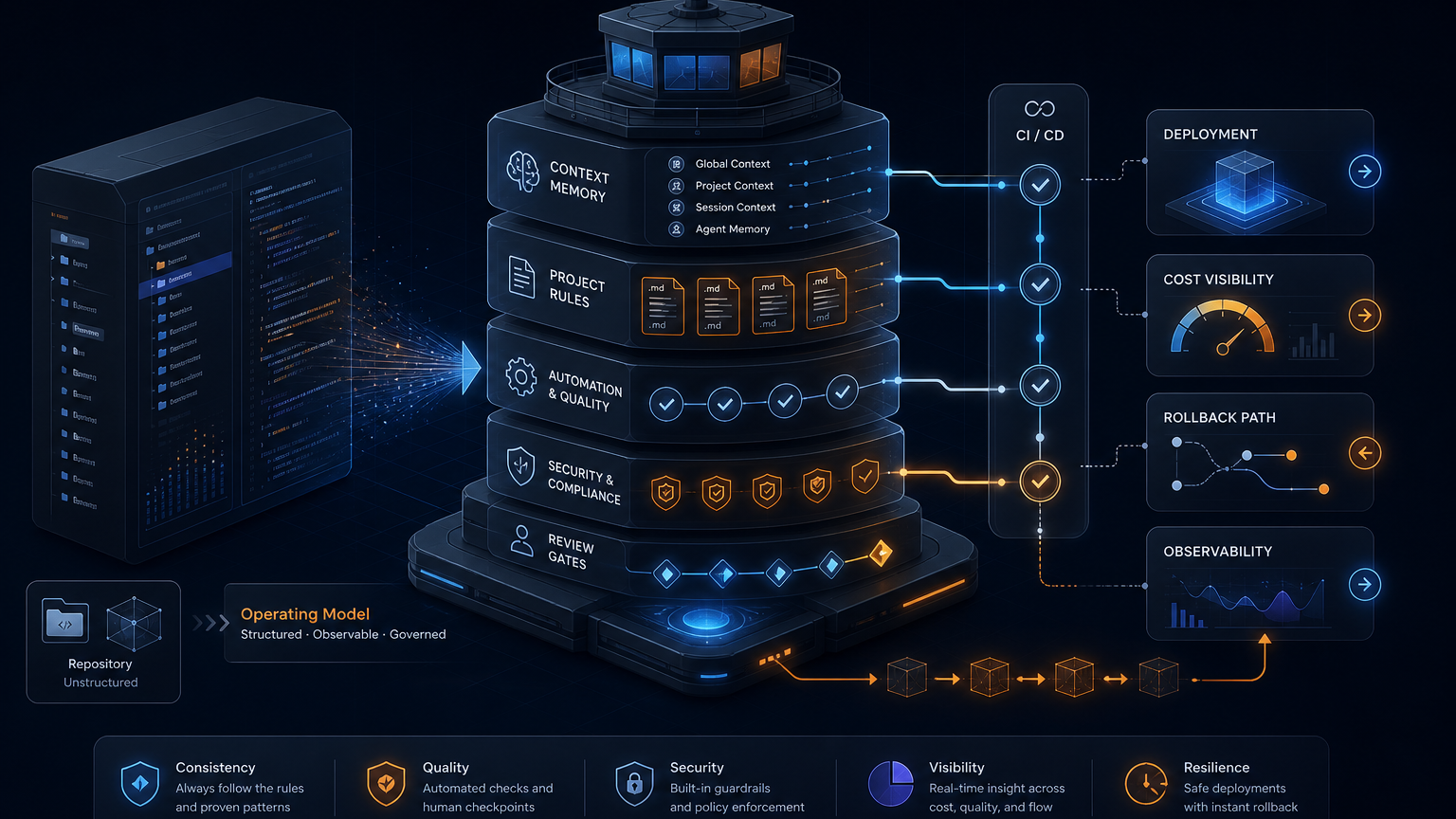

코딩 에이전트의 병목은 이제 “코드를 한 번에 얼마나 많이 쓰느냐”가 아니다. 진짜 병목은 요구사항을 어떻게 잡고, 어떤 의사결정을 사람이 승인하며, 산출물을 어디에 남기고, 품질·비용·보안 검사를 어떤 순서로 통과시킬 것인가다. AWS의 AI-DLC와 새로 주목받은 awslabs/aidlc-workflows는 이 문제를 꽤 노골적으로 건드린다.

2026년 5월 9일 기준 GitHub Trending에서 awslabs/aidlc-workflows가 눈에 띈 이유는 단순히 AWS가 또 하나의 샘플 저장소를 공개했기 때문이 아니다. 이 저장소는 Kiro, Amazon Q Developer, Cursor, Cline, Claude Code, GitHub Copilot, OpenAI Codex 같은 여러 코딩 에이전트에 같은 AI-Driven Development Life Cycle 규칙을 주입하는 방식을 제공한다. 즉 특정 IDE 기능이 아니라, 에이전트가 따라야 할 개발 운영 체계를 파일로 배포하려는 시도다.

이 글은 AWS DevOps 블로그의 AI-Driven Development Life Cycle, awslabs/aidlc-workflows README, AI-DLC Method Definition, Kiro steering 문서, Amazon Q Developer project rules 문서를 바탕으로 정리했다.

기준 시점: 2026-05-09에 확인한 공개 자료 기준이다.

awslabs/aidlc-workflows는 GitHub API 기준 약 1.7k stars, Python 기반, MIT-0 라이선스, 최근 push가 2026-05-08로 확인됐다.

핵심은 “AI가 코드를 쓴다”가 아니라 “AI가 개발 흐름을 끌고 간다”다

AWS 블로그가 AI-DLC를 설명하는 방식은 기존 코딩 어시스턴트 마케팅과 조금 다르다. 글은 먼저 현재 접근을 두 가지로 나눈다.

- AI-assisted development — 문서화, 코드 완성, 테스트 작성처럼 개별 작업을 보조한다.

- AI-autonomous development — 사용자의 요구만 받고 전체 애플리케이션 생성을 기대한다.

AWS의 주장은 둘 다 충분하지 않다는 쪽에 가깝다. 보조형 AI는 기존 SDLC의 비효율을 그대로 둔 채 특정 작업만 빠르게 만들고, 완전 자율형 AI는 품질과 통제 측면에서 아직 믿기 어렵다. 그래서 AI-DLC는 중간 지점을 택한다. AI가 워크플로를 먼저 제안하고 쪼개고 실행하지만, 중요한 판단은 사람이 검토·승인한다.

이 전환은 생각보다 크다. 지금까지 많은 팀은 코딩 에이전트를 “똑똑한 채팅창”으로 다뤘다. 개발자가 질문하고, 모델이 답하고, 개발자가 복붙하거나 수정한다. 하지만 AI-DLC의 기본 그림은 반대다.

- 사람이 목적지와 제약을 준다.

- AI가 계획, 질문, 대안, 구현 단위를 먼저 만든다.

- 사람은 중요한 지점에서 승인하고 방향을 보정한다.

- 계획·요구사항·설계·테스트 같은 산출물은 저장소에 남는다.

즉 에이전트가 단순히 코드를 생성하는 게 아니라, 개발 과정의 대화 방향을 바꾸는 운영자가 된다.

AI-DLC가 말하는 세 단계: Inception, Construction, Operations

AWS 블로그는 AI-DLC를 세 단계로 설명한다.

| 단계 | AI가 주로 하는 일 | 사람이 해야 하는 일 | 실무 의미 |

|---|---|---|---|

| Inception | 비즈니스 의도를 요구사항, 스토리, 작업 단위로 쪼갬 | 질문 검토, 목표·범위·예외 승인 | “무엇을 만들 것인가”를 빨리 구체화 |

| Construction | 아키텍처, 도메인 모델, 코드, 테스트 제안 | 기술 선택, 설계 트레이드오프 검토 | 코드 생성보다 설계 검증이 핵심 |

| Operations | IaC, 배포, 운영 흐름에 이전 컨텍스트 적용 | 배포 리스크, 비용, 보안, 롤백 판단 | 에이전트가 운영까지 문맥을 이어감 |

AI-DLC Method Definition 문서는 이 흐름을 더 강하게 표현한다. 기존 Agile이나 Scrum에 AI를 덧붙이는 게 아니라, AI 속도에 맞춰 방법론 자체를 다시 상상해야 한다고 말한다. 특히 전통적인 긴 반복 주기 대신 hours/days 단위의 빠른 사이클을 전제로 한다.

여기서 흥미로운 건 “더 빨리 코딩하자”보다 “더 자주 검증하자”에 가깝다는 점이다. AI가 빠르게 계획하고 구현할 수 있을수록, 사람의 역할은 더 늦게 개입하는 것이 아니라 더 명확한 게이트를 설계하는 것으로 바뀐다.

awslabs/aidlc-workflows는 방법론을 에이전트 규칙 파일로 바꾼다

AI-DLC가 블로그에서 끝나면 그냥 방법론 글이다. 그런데 awslabs/aidlc-workflows는 이 방법론을 실제 에이전트 설정 파일 묶음으로 배포한다. README에 따르면 릴리스 zip에는 크게 두 종류의 규칙이 들어간다.

aws-aidlc-rules/— 핵심 AI-DLC 워크플로 규칙aws-aidlc-rule-details/— 핵심 규칙이 조건부로 참조하는 상세 규칙

그리고 이를 여러 환경에 맞게 설치하는 방법을 제공한다.

- Kiro:

.kiro/steering/및.kiro/aws-aidlc-rule-details/ - Amazon Q Developer:

.amazonq/rules/및.amazonq/aws-aidlc-rule-details/ - Cursor:

.cursor/rules/ai-dlc-workflow.mdc및.aidlc-rule-details/ - Claude Code, GitHub Copilot, OpenAI Codex 등: 각 도구가 읽을 수 있는 규칙/지시 파일 형태

이 구조가 중요한 이유는 명확하다. 코딩 에이전트 경쟁이 모델 호출 API만으로는 끝나지 않기 때문이다. 팀의 개발 방식은 보통 아래처럼 수많은 암묵지로 이루어져 있다.

- 요구사항은 어떤 수준까지 쪼갤 것인가

- 아키텍처 결정은 언제 멈추고 사람에게 물을 것인가

- 테스트와 보안 검사는 어떤 순서로 돌릴 것인가

- 배포 전 어떤 산출물을 남겨야 하는가

- 비용과 모델 출력 검토는 누가 책임지는가

이걸 매번 프롬프트로 설명하면 운영이 안 된다. 그래서 규칙 파일, steering file, project rules, AGENTS.md 같은 형태로 저장소에 박아두는 방식이 중요해진다.

Kiro steering과 Amazon Q project rules가 보여주는 큰 방향

Kiro 문서는 steering을 “프로젝트에 대한 지속 지식”으로 설명한다. .kiro/steering/ 아래의 Markdown 파일이 프로젝트의 패턴, 라이브러리, 표준을 기억하게 만들고, 매번 같은 설명을 반복하지 않도록 한다는 것이다. 특히 product, tech, structure 같은 foundational steering 파일을 통해 “왜 이 제품을 만드는지”, “어떤 기술 스택을 쓰는지”, “파일 구조와 네이밍은 어떤지”를 에이전트가 일관되게 반영하게 한다.

Amazon Q Developer의 project rules도 같은 방향이다. 프로젝트 단위 규칙을 통해 Q Developer chat이 팀의 규칙을 참고하게 만든다. 결국 이름은 다르지만, 핵심은 같다.

에이전트에게 도구만 주는 게 아니라, 팀의 작업 방식과 판단 기준을 읽게 만드는 것.

이 관점에서 AI-DLC는 단순한 AWS 내부 방법론이 아니라 더 넓은 흐름의 일부다. Browserbase Skills, Claude Skills, Cursor Rules, Kiro Steering, AGENTS.md가 모두 같은 문제를 다른 이름으로 풀고 있다. 모델은 점점 강해지지만, 강한 모델을 조직의 개발 방식에 맞게 붙잡아 두려면 “지속 컨텍스트 + 규칙 + 검토 게이트”가 필요하다.

실무적으로는 “에이전트 도입”보다 “작업 단위 재설계”가 먼저다

AI-DLC를 그대로 도입할지와 별개로, 한국 개발팀이 바로 가져갈 수 있는 포인트는 꽤 실용적이다.

1) 에이전트에게 맡길 일을 코드 파일 기준이 아니라 생애주기 기준으로 나눠라

“이 함수 고쳐줘”는 너무 작고, “서비스 만들어줘”는 너무 크다. AI-DLC식으로 보면 더 좋은 작업 단위는 다음에 가깝다.

- 기능 의도를 요구사항과 예외 케이스로 정리하기

- 요구사항을 테스트 가능한 작업 단위로 쪼개기

- 설계 대안을 만들고 트레이드오프 표로 비교하기

- 구현 후 테스트·보안·문서 체크리스트를 통과시키기

- 배포 전 운영 리스크와 롤백 계획을 검토하기

즉 에이전트에게 “파일 수정”만 맡기지 말고, 작업이 진행되는 단계를 맡겨야 한다.

2) 프로젝트 규칙은 README보다 더 실행 가능해야 한다

많은 팀의 README는 사람에게는 유용하지만 에이전트에게는 너무 추상적이다. “테스트를 잘 작성하라”, “보안을 고려하라”는 규칙은 거의 작동하지 않는다. 대신 아래처럼 실행 가능한 규칙이 필요하다.

- 새 API를 만들면 request/response 예시와 실패 케이스를 함께 추가한다.

- DB 스키마 변경이 있으면 migration, rollback note, seed 영향 범위를 같이 쓴다.

- 인증/권한 코드가 바뀌면 관련 테스트와 threat note를 남긴다.

- 외부 API 호출이 추가되면 timeout, retry, rate limit, 비용 영향을 명시한다.

이 정도로 구체적이어야 코딩 에이전트가 “좋은 개발자처럼” 움직일 가능성이 생긴다.

3) 사람의 개입 지점을 늦추지 말고 앞당겨라

AI가 빠르기 때문에 사람은 나중에 검토하면 된다고 생각하기 쉽다. 하지만 실제로는 반대다. 요구사항이 틀린 상태에서 빠르게 코드를 많이 만들면 리뷰 비용만 폭증한다. AI-DLC의 plan → clarification → validation → implementation 루프는 이 문제를 줄이려는 구조다.

실무적으로는 최소한 아래 세 지점에서 사람이 개입해야 한다.

- 요구사항이 작업 단위로 쪼개진 직후

- 아키텍처/데이터 모델/외부 의존성이 정해지기 직전

- 배포·운영·보안 영향이 생기기 직전

이 세 지점을 자동화로 건너뛰면, 코딩 에이전트는 생산성 도구가 아니라 부채 생성기가 될 수 있다.

주의할 점: AI-DLC는 만능 방법론이라기보다 “운영 가설”이다

AI-DLC의 방향은 설득력이 있지만, 그대로 받아들이면 안 되는 지점도 있다.

첫째, AI가 워크플로를 주도한다는 말은 조직마다 다르게 해석될 수 있다. 규제가 강한 금융·의료·공공 영역에서는 AI가 질문을 만들고 계획을 세우는 것 자체는 괜찮아도, 승인·기록·감사 체계가 훨씬 엄격해야 한다.

둘째, 에이전트 규칙 파일은 시간이 지나면 낡는다. 프로젝트 구조가 바뀌었는데 .kiro/steering, .amazonq/rules, .cursor/rules, AGENTS.md가 업데이트되지 않으면 에이전트는 오히려 과거의 결정을 증폭한다. 따라서 규칙 파일도 코드처럼 리뷰하고 버전 관리해야 한다.

셋째, 비용과 책임의 문제가 남는다. awslabs/aidlc-workflows README도 생성형 AI가 실수할 수 있고, 선택한 모델과 에이전트가 만든 출력과 비용을 검토해야 한다고 명시한다. AWS Responsible AI Policy 역시 AI/ML 서비스 사용자가 의사결정, 조언, 행동, 미조치에 대해 책임을 진다는 점을 분명히 한다.

요컨대 AI-DLC는 “AI에게 개발을 맡기자”가 아니라, AI가 더 많은 개발 과정을 건드릴수록 책임 구조를 더 명확히 하자는 쪽으로 읽는 게 맞다.

SEO보다 중요한 실무 결론: 코딩 에이전트의 다음 전장은 “규칙의 제품화”다

요즘 에이전트 생태계를 보면 비슷한 패턴이 반복된다.

- Browserbase는 브라우저 세션과 skills를 묶는다.

- Flutter는 Flutter 개발용 agent skills를 공개한다.

- Addy Osmani의

agent-skills는 생산급 엔지니어링 스킬과 slash command를 묶는다. - AWS는 AI-DLC를 Kiro, Amazon Q, Cursor, Claude Code, Copilot, Codex가 읽을 수 있는 워크플로 규칙으로 배포한다.

공통점은 하나다. 에이전트의 품질을 “프롬프트를 잘 쓰는 개인 능력”에 맡기지 않고, 재사용 가능한 운영 자산으로 바꾸려는 것이다.

한국 개발팀 입장에서 지금 할 일은 특정 에이전트 하나를 고르는 것보다, 자기 팀의 개발 생애주기를 에이전트가 읽을 수 있는 형태로 정리하는 것이다.

- 제품 의도는 어디에 기록할 것인가

- 기술 스택과 금지 패턴은 어디에 둘 것인가

- 테스트·보안·배포 체크리스트는 어떤 파일로 유지할 것인가

- 에이전트가 반드시 멈춰야 하는 승인 지점은 무엇인가

- 결과 산출물은 PR, 이슈, 문서, 로그 중 어디에 남길 것인가

이 질문에 답하지 못하면 어떤 모델을 써도 에이전트 도입은 “가끔 신기한 자동완성”에 머문다. 반대로 이 구조가 잡히면 모델이 바뀌어도 팀의 운영 지식은 남는다.

한 줄 결론

AWS AI-DLC와 awslabs/aidlc-workflows의 핵심은 코딩 에이전트를 더 세게 풀어놓는 것이 아니다. 오히려 반대다. 에이전트가 개발 생애주기 전체에 들어올수록, 계획·컨텍스트·규칙·검토 게이트를 저장소 안에 명시해야 한다는 신호다. 앞으로 코딩 에이전트 경쟁은 “누가 더 많은 코드를 생성하느냐”보다 “누가 팀의 개발 방식을 더 안정적으로 실행하느냐”로 이동할 가능성이 크다.