- Published on

NVIDIA VSS Blueprint: 영상 검색을 운영 에이전트의 기본 인터페이스로 바꾸는 설계

- Authors

- Name

- Kyunghyun Park

- @devkhpark

NVIDIA VSS · Video Search · Vision Agent · NIM · MCP

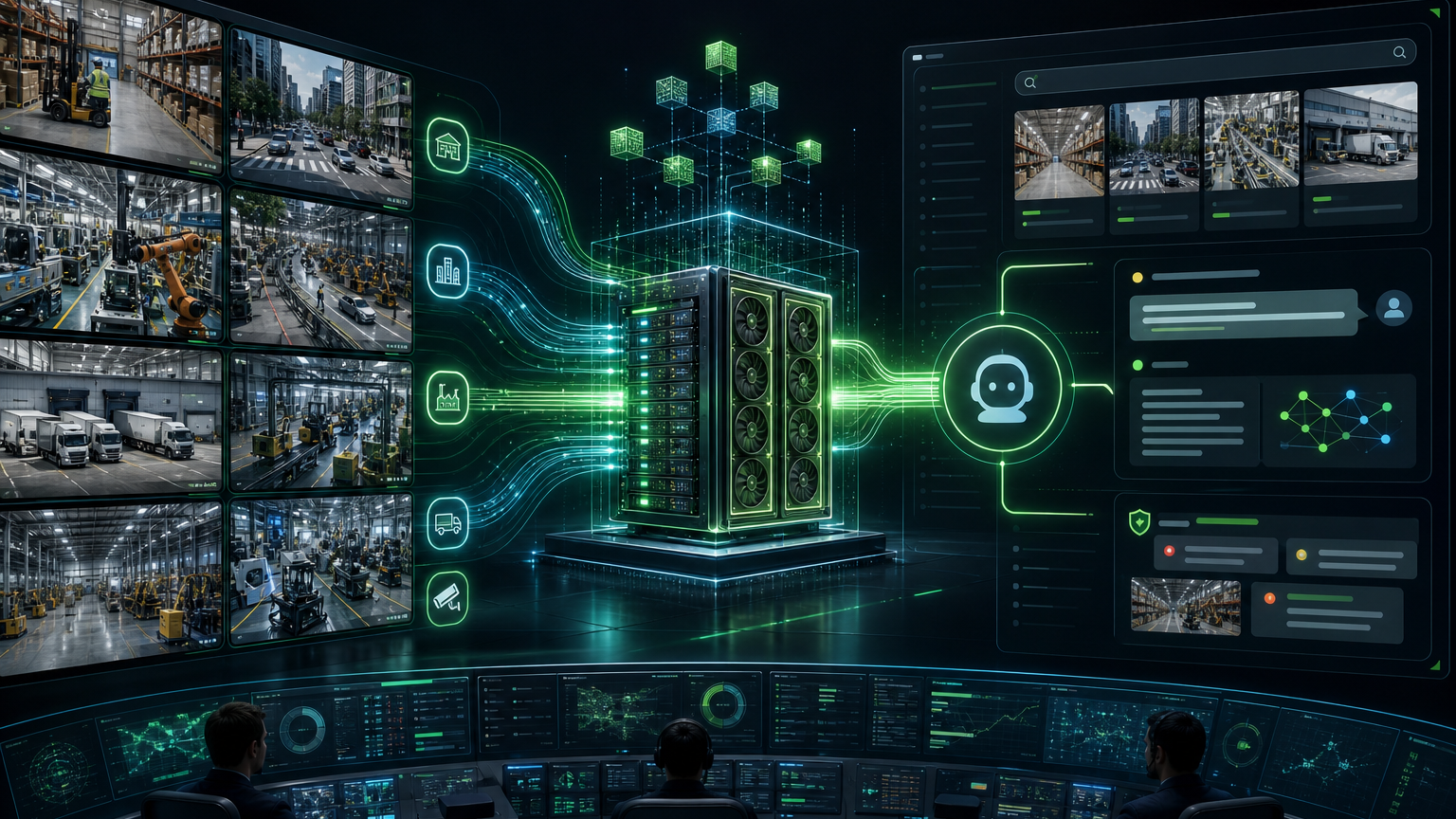

NVIDIA의 Video Search and Summarization(VSS) Blueprint가 흥미로운 이유는 “영상을 요약해주는 AI” 수준에 있지 않다. 핵심은 훨씬 더 실무적이다. 영상 데이터를 사람이 직접 뒤지는 아카이브에서, 에이전트가 검색하고 검증하고 보고서로 바꾸는 운영 데이터베이스로 재정의한다는 점이다.

2026년 5월 15일 기준 GitHub Trending에 오른 NVIDIA-AI-Blueprints/video-search-and-summarization 저장소는 GPU 가속 비전 마이크로서비스, VLM, LLM, NIM, MCP 기반 도구 인터페이스를 하나의 레퍼런스 아키텍처로 묶는다. 공식 문서도 VSS를 “vision agents and AI-powered video analytics applications”를 만들기 위한 참조 아키텍처 묶음이라고 설명한다.

이 글은 NVIDIA의 공식 VSS 문서, GitHub 저장소, VSS prerequisites 문서를 기준으로, 한국 개발자·AI 빌더·운영 조직 입장에서 이 Blueprint를 어떻게 읽어야 하는지 정리한 것이다.

기준 시점: 이 글은 2026-05-15에 확인한 NVIDIA VSS 3.1.0/latest 문서와 GitHub 저장소 기준이다. Blueprint와 모델 구성, 하드웨어 요구사항은 빠르게 바뀔 수 있으니 실제 도입 전 공식 문서를 다시 확인해야 한다.

결론부터: VSS는 “영상 챗봇”이 아니라 운영 시스템의 질의 계층이다

많은 영상 AI 데모는 “이 영상에 뭐가 보여?” 또는 “요약해줘”에서 끝난다. VSS가 더 중요한 이유는 거기서 한 단계 더 나아가기 때문이다. NVIDIA가 제시하는 구조는 저장 영상과 실시간 스트림을 모두 처리하고, 그 결과를 다운스트림 분석과 에이전트 도구 호출로 연결한다.

공식 README는 VSS를 세 영역으로 나눈다.

- Real-time video intelligence — 영상에서 특징, 임베딩, 스트림 이해 결과를 추출하고 메시지 브로커로 내보낸다.

- Downstream analytics — 원시 탐지 결과를 궤적, 사건, 검증된 알림 같은 운영 단위로 바꾼다.

- Agentic and offline processing — 검색, Q&A, 요약, 클립 검색을 에이전트가 도구처럼 호출한다.

여기서 포인트는 “모델 하나”가 아니다. VSS는 영상 처리 파이프라인, 검색 인덱스, 이벤트 분석, 알림 검증, 보고서 생성, UI, 배포 프로파일을 한꺼번에 묶는 운영형 AI Blueprint에 가깝다.

그래서 이 주제의 SEO 키워드도 단순히 “video summarization AI”가 아니라 다음처럼 잡는 편이 낫다.

- NVIDIA VSS Blueprint

- AI video search architecture

- vision agent workflow

- video analytics with VLM and LLM

- NIM video search summarization

- MCP vision agent tools

왜 지금 중요한가: 기업 영상은 너무 많고, 사람 검색은 너무 느리다

CCTV, 공장 카메라, 물류창고 영상, 매장 영상, 안전 점검 영상은 이미 데이터로 쌓이고 있다. 문제는 대부분의 조직에서 이 영상이 “검색 가능한 지식”이 아니라 “필요하면 사람이 돌려보는 기록물”로 남아 있다는 점이다.

VSS가 겨냥하는 문제는 바로 이 병목이다. README는 적용 사례로 smart spaces, warehouse automation, SOP validation을 언급한다. 공식 문서는 smart city, warehouse operations 같은 산업별 예시도 제공한다.

실무적으로 이건 아래 질문으로 바뀐다.

- “지난 12시간 동안 지게차가 통로를 막은 장면을 찾아줘.”

- “작업자가 안전 장비 없이 위험 구역에 들어간 사건만 모아줘.”

- “이 알림이 실제 위반인지, 단순 오탐인지 영상 근거로 검증해줘.”

- “긴 영상을 사람이 보지 않고 주요 이벤트와 근거 클립으로 보고서를 만들어줘.”

이런 질문은 전통적인 객체 탐지 모델 하나로는 풀기 어렵다. 객체 인식, 시간 축 추적, 임베딩 검색, VLM 기반 해석, LLM 기반 보고서 생성, 운영 알림 검증이 함께 필요하다. VSS는 이 조합을 하나의 레퍼런스 아키텍처로 제시한다.

아키텍처를 읽는 가장 쉬운 방법: 탐지 → 의미화 → 에이전트화

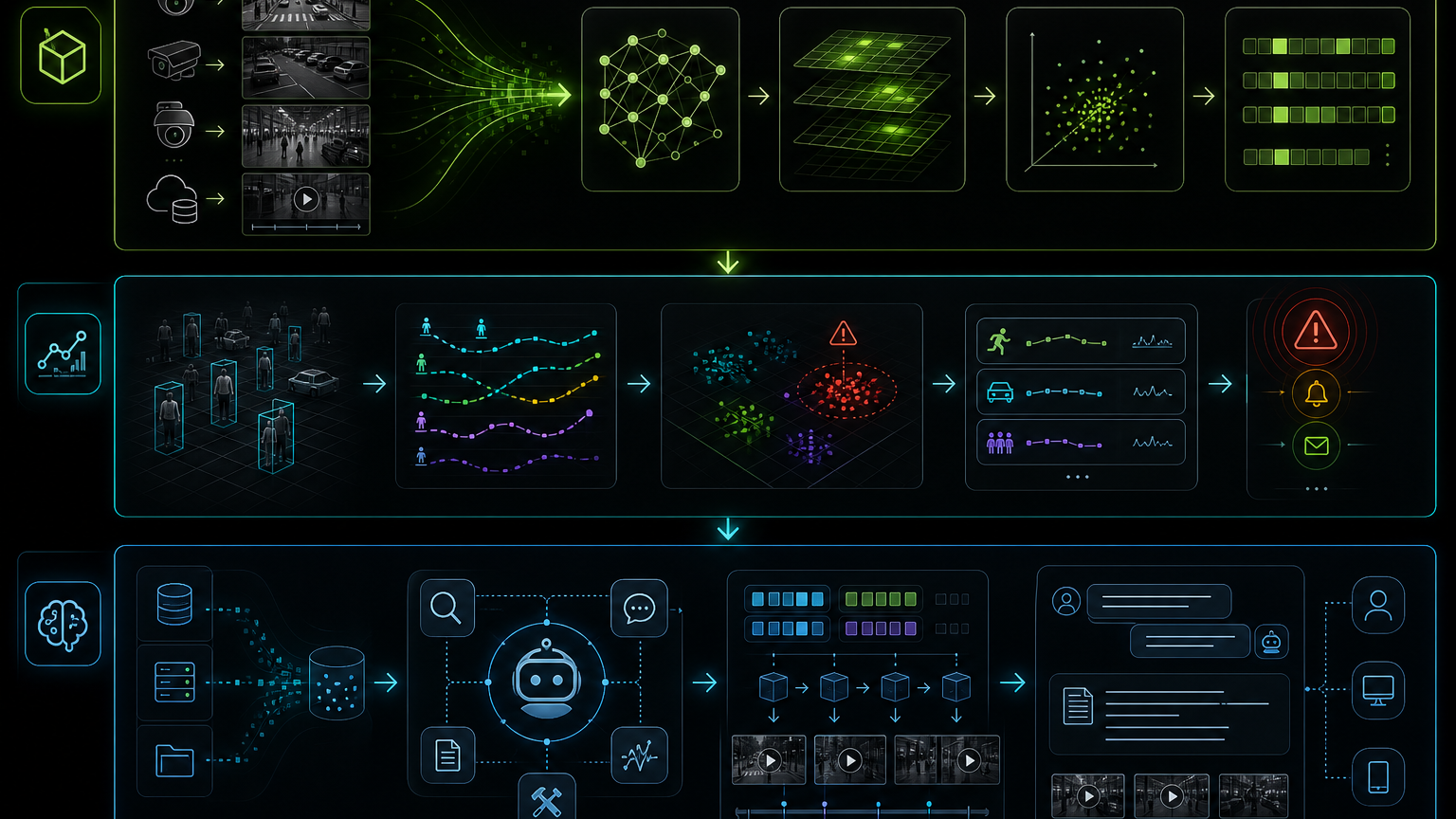

VSS 구조를 너무 복잡하게 보면 오히려 핵심이 흐려진다. 개발자 입장에서는 세 단계로 보면 된다.

1) 탐지와 임베딩: 영상에서 기계가 읽을 수 있는 신호를 뽑는다

공식 문서의 Real-Time Video Intelligence 계층은 RT-CV, RT-Embedding, RT-VLM 같은 서비스를 포함한다. RT-CV는 DeepStream SDK와 RT-DETR, Grounding DINO, Sparse4D 같은 모델을 활용해 객체 탐지·분류·추적을 수행한다. RT-Embedding은 Cosmos-Embed1 계열을 사용해 영상·이미지·RTSP 스트림에서 의미 임베딩을 만든다. RT-VLM은 Cosmos Reason1/2, Qwen3-VL 같은 VLM으로 자연어 캡션, 사건 감지, 이상 징후 탐지를 수행한다.

여기서 생성되는 건 단순한 프레임별 라벨이 아니다. 검색과 추론에 쓸 수 있는 시간·객체·의미 신호다.

2) 다운스트림 분석: 원시 탐지를 운영 이벤트로 바꾼다

Downstream Analytics 계층은 탐지 결과를 바로 사용자에게 던지지 않는다. Behavior Analytics는 Kafka, Redis Streams, MQTT 같은 메시지 브로커에서 프레임 메타데이터를 받아 객체 이동, 속도, 방향, 궤적, ROI 진입/이탈, 제한 구역 위반 같은 운영 이벤트로 가공한다.

또 Alert Verification Service는 상위 분석에서 올라온 알림과 사건을 받아 관련 영상 구간을 찾고, VLM으로 실제 알림인지 검증한다. 공식 문서에 따르면 검증 결과는 confirmed, rejected, unverified 같은 verdict와 reasoning trace로 저장될 수 있다.

이 부분이 중요하다. 실제 운영에서는 “탐지했다”보다 “이 알림을 믿어도 되는가”가 더 큰 문제다. VSS는 그 사이에 검증 계층을 넣는다.

3) 에이전트 계층: 영상 검색과 요약을 도구 호출로 만든다

공식 문서에서 가장 눈에 띄는 부분은 Agent and Offline Processing이다. Top-level agent는 Model Context Protocol(MCP)을 통해 비디오 분석 데이터, 사건 기록, 비전 처리 기능에 접근한다. 즉 검색, Q&A, 요약, 클립 검색이 별도 API 조각이 아니라 에이전트가 호출하는 도구가 된다.

이 구조는 앞으로 기업용 영상 AI가 가는 방향을 꽤 선명하게 보여준다. 사용자는 더 이상 “어느 폴더의 어느 영상을 몇 분부터 볼지”를 먼저 고민하지 않는다. 대신 운영 질문을 던지고, 에이전트가 영상 인덱스와 분석 결과를 찾아 근거와 함께 답하는 방식으로 바뀐다.

자연어 영상 검색이 진짜 제품 기능이 되는 지점

VSS의 Agent Workflows에는 Q&A and Report Generation, Alert Verification, Real-Time Alerts, Video Search, Long Video Summarization이 포함된다. 이 중에서 가장 제품화 가능성이 큰 축은 자연어 검색과 장시간 영상 요약이다.

전통적인 영상 검색은 메타데이터가 부족하면 거의 불가능하다. 파일명, 카메라 위치, 시간대 정도로만 찾을 수 있다. 그런데 VSS식 접근은 영상 자체에서 임베딩과 캡션, 사건 단서를 만들고, 이를 에이전트 도구로 연결한다.

실무에서 이 변화는 꽤 크다.

| 기존 방식 | VSS식 방식 |

|---|---|

| 사람이 시간대를 추정하고 직접 재생 | 자연어 질의로 관련 클립 후보 검색 |

| 객체 탐지만 하고 알림은 오탐이 많음 | VLM 기반 알림 검증으로 confirmed/rejected 구분 |

| 긴 영상을 사람이 요약 | chunking과 dense caption 기반 장시간 요약 |

| 분석 기능이 앱마다 따로 구현 | MCP 도구 계층으로 에이전트가 기능 호출 |

| PoC와 운영 시스템 사이가 큼 | Blueprint, Docker Compose, launchable deployment로 경로 제시 |

이건 단순히 “비디오 검색이 편해졌다”가 아니다. 영상이 운영 의사결정에 들어가는 방식이 바뀐다. 안전, 보안, 물류, 제조, 리테일에서는 영상이 이미 많다. 부족한 건 영상을 질의 가능한 시스템으로 바꾸는 계층이다.

NIM과 모델 구성: NVIDIA가 팔고 싶은 건 모델보다 배포 가능한 스택이다

README는 VSS에서 사용하는 NIM microservices 예시로 Cosmos-Reason2-8B와 NVIDIA Nemotron-Nano-9B-v2를 언급한다. 여기서 읽어야 할 것은 특정 모델 이름보다 NVIDIA가 모델을 NIM 단위의 배포 가능한 마이크로서비스로 포장하고 있다는 점이다.

LLM/VLM을 도입할 때 많은 조직이 겪는 문제는 모델 성능 자체보다 운영이다.

- 어떤 GPU 토폴로지에서 돌릴 것인가?

- 모델 서버, 영상 파이프라인, 메시지 브로커, 검색 인덱스를 어떻게 묶을 것인가?

- 실시간 스트림과 저장 영상을 같은 방식으로 다룰 수 있는가?

- PoC 이후 운영 환경으로 옮길 때 얼마나 다시 만들어야 하는가?

VSS는 이 질문에 “모델 API 하나 쓰세요”라고 답하지 않는다. 대신 Docker Compose, deployment profiles, NIM, UI, agent, skills 디렉터리를 포함한 저장소 구조로 답한다. GitHub 저장소의 최상위 구조도 agent/, deployments/, skills/, ui/로 나뉘어 있다.

이건 NVIDIA의 전략과도 맞다. 생성형 AI 경쟁이 모델 카드 경쟁에서 끝나지 않고, GPU에서 실제 워크로드를 굴리는 레퍼런스 스택 경쟁으로 이동하고 있다는 신호다.

배포 관점에서 보면 꽤 무겁다: PoC와 운영 도입을 분리해야 한다

VSS는 흥미롭지만 가볍게 “npm install 하고 끝”나는 도구는 아니다. 공식 prerequisites 문서는 검증된 GPU로 H100, RTX PRO 6000 Blackwell, L40S, DGX SPARK, IGX Thor, AGX Thor를 언급한다. 소프트웨어 요구사항도 Ubuntu 22.04/24.04, NVIDIA Driver, NVIDIA Container Toolkit, Docker, Docker Compose, NGC CLI 등을 요구한다.

그래서 실무 도입은 두 단계로 보는 편이 안전하다.

1단계: launchable 또는 제한된 샘플 영상으로 빠르게 검증

README는 Brev Launchable을 “자체 영상으로 빠르게 시작하기 좋은 경로”로 제시한다. 이 단계의 목표는 전체 인프라 최적화가 아니다. 아래를 확인하는 것이다.

- 우리 영상에서 검색·요약 품질이 실제로 의미 있는가?

- 알림 검증이 오탐을 줄이는가?

- 사용자가 자연어 질문을 던졌을 때 원하는 근거 클립을 찾는가?

- 운영자가 보고서를 신뢰할 수 있는가?

2단계: Docker Compose / 온프레미스 GPU / 엣지 환경 검토

두 번째 단계는 운영 배포다. 이때는 모델 품질보다 아래 질문이 더 중요해진다.

- 영상 스트림 수가 늘 때 처리량이 버티는가?

- 메시지 브로커와 저장소 구성이 장애에 강한가?

- 개인정보·보안 정책상 영상을 클라우드로 보낼 수 있는가?

- VLM 검증 결과를 누가 승인하고 어떻게 감사 로그로 남길 것인가?

- 기존 VMS, WMS, MES, SIEM, 티켓 시스템과 어떻게 연결할 것인가?

VSS는 Blueprint이기 때문에 “완제품 SaaS”처럼 생각하면 실망할 수 있다. 반대로 자체 영상 운영 시스템을 만들려는 팀에게는 매우 구체적인 출발점이 될 수 있다.

한국 개발자와 운영팀에게 주는 실무적 의미

한국 시장에서 이 주제가 중요한 이유는 명확하다. 제조, 물류, 건설, 리테일, 공공 안전, 스마트시티 쪽에는 이미 카메라가 많다. 하지만 영상 분석은 여전히 제한적인 이벤트 탐지나 사후 확인에 머무는 경우가 많다.

VSS식 구조가 들어오면 제품 요구사항이 이렇게 바뀐다.

- “CCTV AI 붙여주세요” → “영상 기반 운영 질문에 답하는 에이전트를 만들어주세요”

- “객체 탐지 정확도 몇 퍼센트인가요?” → “오탐 알림을 얼마나 줄이고, 근거 클립을 얼마나 빨리 찾나요?”

- “대시보드에 이벤트를 보여주세요” → “이 사건의 원인과 유사 사례를 보고서로 만들어주세요”

- “모델 API 연동해주세요” → “비디오 파이프라인, 인덱스, 브로커, 에이전트 도구, 감사 로그를 설계해주세요”

즉 개발 난이도는 올라간다. 대신 제대로 만들면 단순 탐지 솔루션보다 훨씬 높은 업무 가치를 만들 수 있다.

SEO 관점의 핵심 키워드와 검색 의도

이 글을 검색하는 사람의 의도는 크게 네 가지로 나뉠 가능성이 높다.

- NVIDIA VSS가 무엇인지 알고 싶은 사람

- 핵심 답: 영상 검색·요약을 위한 NVIDIA AI Blueprint이며, vision agent와 video analytics 애플리케이션을 만드는 참조 아키텍처다.

- 비디오 검색 AI를 만들고 싶은 개발자

- 핵심 답: 단일 VLM 호출보다 임베딩, 이벤트 분석, 에이전트 도구 계층을 함께 설계해야 한다.

- 스마트시티·물류·제조 영상 분석을 검토하는 운영팀

- 핵심 답: 자연어 검색과 알림 검증이 사후 검색·오탐·보고서 작성 비용을 줄일 수 있다.

- NVIDIA NIM / GPU 인프라 관점에서 도입성을 보는 팀

- 핵심 답: PoC는 launchable로 시작할 수 있지만 운영 배포는 GPU, Docker, NGC, 메시지 브로커, 보안 정책까지 함께 봐야 한다.

따라서 VSS를 소개할 때 “영상 요약 AI”라고만 쓰면 검색 의도를 놓친다. 더 정확한 표현은 **“영상 데이터를 운영 에이전트가 질의 가능한 인프라로 바꾸는 NVIDIA 레퍼런스 스택”**이다.

한계와 주의점: Blueprint는 완제품이 아니다

좋은 Blueprint일수록 오히려 오해하면 안 된다. VSS는 완제품 SaaS가 아니라 레퍼런스 아키텍처다. 따라서 다음 리스크를 먼저 봐야 한다.

- 하드웨어 요구사항이 가볍지 않다.

- 실제 영상 품질, 카메라 각도, 조명, 도메인 특성에 따라 성능 편차가 클 수 있다.

- VLM 기반 알림 검증은 유용하지만, 법적·운영적 판단을 완전히 대체하면 안 된다.

- 영상 데이터는 개인정보·보안 이슈가 크므로 저장, 접근, 로그, 삭제 정책이 필요하다.

- 자연어 검색 결과는 근거 클립과 함께 검증 가능한 형태로 보여줘야 한다.

특히 한국 기업 환경에서는 개인정보보호법, 영상정보처리기기 운영 정책, 사내 보안 정책이 도입 설계를 좌우할 가능성이 높다. “모델이 가능하다”와 “운영 시스템으로 쓸 수 있다”는 다른 문제다.

실무 도입 체크리스트

VSS를 검토하는 팀이라면 아래 순서로 보는 것을 추천한다.

- 업무 질문을 먼저 정의한다

- 예: “오탐을 줄이고 싶은가?”, “사후 검색 시간을 줄이고 싶은가?”, “장시간 영상을 보고서화하고 싶은가?”

- 샘플 영상으로 검색·요약·알림 검증 품질을 테스트한다

- 데모 영상이 아니라 실제 카메라 영상이어야 한다.

- 실시간성과 배치 처리 요구사항을 분리한다

- 실시간 알림과 장시간 요약은 비용 구조가 다르다.

- GPU와 배포 형태를 정한다

- Launchable, 온프레미스, 엣지, 클라우드 GPU 중 어디가 맞는지 봐야 한다.

- 근거 클립과 감사 로그를 제품 요구사항에 넣는다

- 운영자가 결과를 신뢰하려면 “왜 그렇게 판단했는지”가 남아야 한다.

- 기존 운영 시스템과 연결한다

- WMS, MES, 보안관제, 티켓, 알림 시스템과 연결되지 않으면 데모에서 끝난다.

짧은 결론

NVIDIA VSS Blueprint의 본질은 영상 요약 모델이 아니다. 영상 스트림과 저장 영상을 실시간 인텔리전스, 다운스트림 분석, 에이전트형 검색·요약 계층으로 연결해 영상 데이터를 질의 가능한 운영 인프라로 바꾸는 설계다.

한국 개발자와 운영팀에게 중요한 질문은 “이게 멋진가?”가 아니다. “우리 조직의 영상 데이터가 지금은 사람이 뒤지는 비용 덩어리인가, 아니면 에이전트가 검색하고 검증하고 보고서화할 수 있는 운영 자산인가?”다. VSS는 그 질문을 꽤 구체적으로 던지는 Blueprint다.