- Published on

ByteDance DeerFlow 2.0: Deep Research가 SuperAgent 워크벤치로 바뀌는 순간

- Authors

- Name

- Kyunghyun Park

- @devkhpark

ByteDance · DeerFlow 2.0 · SuperAgent Harness

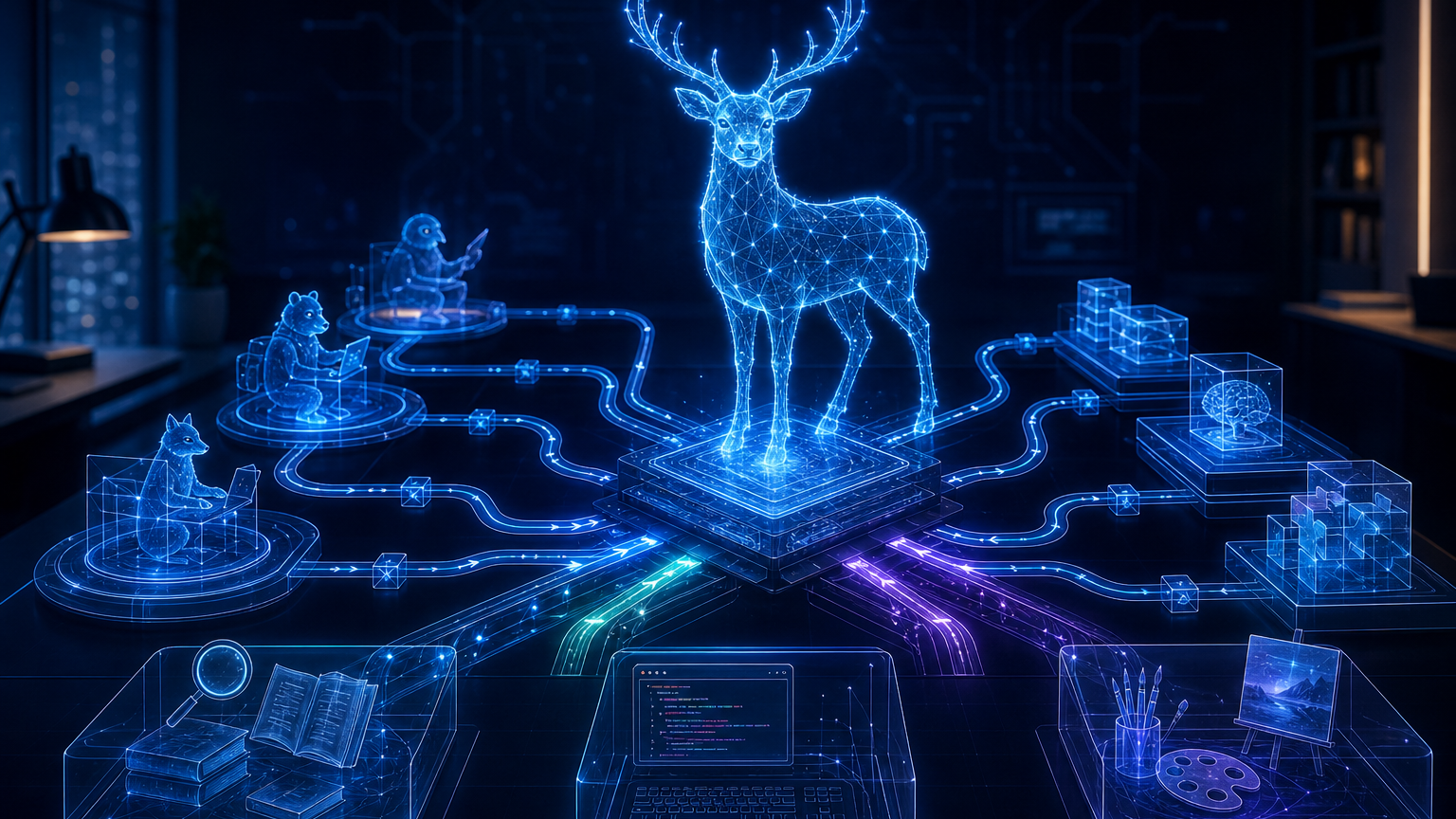

ByteDance의 DeerFlow 2.0은 단순히 “오픈소스 Deep Research 도구가 하나 더 나왔다” 정도로 보면 놓치는 게 많다. README와 공식 사이트가 반복해서 강조하는 키워드는 Deep Research가 아니라 SuperAgent harness다. 즉 검색해서 보고서를 쓰는 에이전트에서, 샌드박스·메모리·툴·스킬·서브에이전트를 엮어 몇 분에서 몇 시간짜리 작업을 실행하는 워크벤치로 이동하고 있다.

이 글은 bytedance/deer-flow GitHub README, DeerFlow 공식 사이트, Install.md, 그리고 DeerFlow가 새로 통합했다고 밝힌 BytePlus Info Quest 문서를 기준으로 정리했다. 기준 시점은 2026-05-07이다.

핵심은 “Deep Research 앱”이 아니라 “장시간 작업용 에이전트 하네스”다

DeerFlow README는 프로젝트를 Deep Exploration and Efficient Research Flow라고 풀어 쓰면서도, 설명의 무게중심을 “research”에만 두지 않는다. 공식 설명은 더 직접적이다. DeerFlow는 sub-agents, memory, sandboxes, tools, skills를 조율해서 research, coding, creation을 수행하는 open-source SuperAgent harness라고 말한다.

여기서 중요한 단어는 harness다. 에이전트 제품이 데모를 넘어서려면 모델 호출 하나가 아니라 실행 환경 전체가 필요하다. 작업을 쪼갤 planner, 병렬로 움직일 sub-agent, 중간 산출물을 저장할 파일 시스템, 오래 걸리는 명령을 돌릴 sandbox, 사용자별 맥락을 유지할 memory, 외부 서비스를 붙이는 MCP/도구 레이어가 같이 있어야 한다.

DeerFlow 2.0은 이 조각들을 한 리포지토리 안에 모으는 방향으로 재작성됐다. README는 2.0이 v1과 코드를 공유하지 않는 ground-up rewrite라고 못 박는다. 이건 작은 버전업이라기보다 포지셔닝 변경에 가깝다. v1이 Deep Research 프레임워크였다면, 2.0은 “에이전트가 실제 컴퓨터를 갖고 오래 일하게 만드는 런타임”을 목표로 한다.

왜 지금 DeerFlow가 의미 있나: 에이전트의 병목이 모델에서 운영체제로 내려왔다

최근 오픈소스 에이전트 도구의 흐름을 보면, “어떤 LLM을 쓰는가”만으로 차별화하기 어렵다. 모델은 OpenAI, Claude, Gemini, DeepSeek, Kimi, Doubao처럼 계속 바뀐다. 반면 실제 제품을 만드는 팀이 막히는 지점은 꽤 반복적이다.

- 작업을 어디까지 자동 실행하게 둘 것인가

- 파일 쓰기와 셸 실행을 얼마나 안전하게 격리할 것인가

- 웹 검색과 링크 읽기 결과를 어떻게 LLM 친화적으로 넣을 것인가

- 서브에이전트를 켰을 때 비용·시간·실패를 어떻게 관측할 것인가

- 사용자가 Slack, Telegram, Feishu 같은 채널에서 일을 던져도 같은 런타임으로 처리할 수 있는가

DeerFlow가 흥미로운 이유는 이 질문들을 모델 레벨이 아니라 운영 레벨에서 다룬다는 점이다. README의 Quick Start는 make setup, make doctor, Docker dev/prod 실행, config 기반 sandbox mode, MCP server, IM channels를 전면에 둔다. 공식 사이트도 “Agent Runtime Environment”를 강조하면서 에이전트에게 명령 실행, 파일 관리, 장시간 작업을 수행할 수 있는 컴퓨터를 준다고 설명한다.

내 해석은 이렇다. DeerFlow 2.0은 “똑똑한 에이전트 프롬프트”가 아니라 에이전트 운영체제의 초기 형태에 가깝다. 모델은 교체 가능한 엔진이고, 제품의 실체는 격리된 실행 환경·툴 계약·메모리·채널·관측성 쪽에 생긴다.

샌드박스가 부가 기능이 아니라 제품의 중심이다

DeerFlow 공식 사이트는 All-in-One Sandbox를 추천한다. 이 sandbox는 Browser, Shell, File, MCP, VSCode Server를 하나의 Docker 컨테이너 안에 묶는 접근이다. README도 sandbox mode를 Local Execution, Docker Execution, Docker Execution with Kubernetes로 나누고, Docker 개발 환경에서는 config에 따라 provisioner를 켜거나 끄는 식으로 동작한다고 설명한다.

이 설계가 중요한 이유는 간단하다. 에이전트가 “읽기만 하는 도구”일 때는 안전 문제가 비교적 작다. 하지만 코드를 쓰고, 파일을 만들고, 셸을 실행하고, 브라우저를 조작하고, 장시간 작업을 돌리기 시작하면 이야기가 달라진다. 이제 실패는 틀린 답변이 아니라 잘못된 파일 수정, 비싼 API 호출, 보안 사고, 리소스 고갈로 이어질 수 있다.

그래서 DeerFlow의 sandbox 강조는 장식이 아니다. “에이전트가 무언가를 실행한다”는 약속을 하려면 실행의 경계가 먼저 정의돼야 한다.

특히 실무에서는 아래 기준이 중요해진다.

- 격리 — 에이전트가 호스트 머신 전체를 건드리지 않게 해야 한다.

- 지속성 — 긴 작업의 중간 파일과 상태가 유지돼야 한다.

- 관측성 — 무엇을 실행했고 어디서 실패했는지 추적 가능해야 한다.

- 교체 가능성 — 로컬 개발, Docker, Kubernetes 실행을 상황별로 바꿀 수 있어야 한다.

DeerFlow가 이 문제를 완전히 해결했다는 뜻은 아니다. 오히려 진짜 검증은 여기서부터다. 하지만 2.0의 방향은 맞다. 에이전트가 앱 안의 버튼이 아니라 작업자에 가까워질수록, 모델 품질보다 sandbox/runtime 품질이 사용자 신뢰를 더 크게 좌우한다.

Skills와 MCP는 “에이전트 플러그인”보다 “작업 계약”에 가깝다

DeerFlow 공식 사이트는 Agent Skills를 “필요할 때만 progressive하게 로드되는 파일”로 설명한다. README도 configurable MCP servers와 skills를 통해 기능을 확장한다고 쓴다. 이 조합은 요즘 에이전트 생태계에서 꽤 중요한 패턴이다.

기존의 플러그인 모델은 대개 “이 API를 호출할 수 있다”에 가까웠다. 하지만 에이전트 작업에서는 API 호출보다 절차가 더 중요하다. 예를 들어 배포, 리서치, 코드 리뷰, 데이터 분석, 이미지 생성은 단순 함수 하나가 아니다. 어떤 순서로 확인하고, 무엇을 검증하고, 실패하면 어디서 멈출지까지 포함한 작업 계약이 필요하다.

Skills는 이 절차를 문서와 스크립트로 포장한다. MCP는 외부 도구와 서비스 연결을 표준화한다. DeerFlow가 둘을 같이 전면에 두는 건, 에이전트 제품의 확장성이 “더 많은 버튼”이 아니라 더 많은 재사용 가능한 작업 방식에서 나온다는 뜻이다.

여기에 BytePlus Info Quest 통합도 같은 맥락으로 읽힌다. Info Quest 문서는 Web Search, Link Reader, MCP service를 제공한다고 설명한다. DeerFlow README는 Info Quest를 intelligent search and crawling toolset으로 새로 통합했다고 밝힌다. 즉 검색도 단순 웹 검색 API가 아니라, 에이전트가 구조화된 외부 정보를 안정적으로 가져오는 도구 체인으로 들어간다.

메시징 채널 지원은 사소해 보이지만 운영상 꽤 크다

README의 IM Channels 섹션은 Telegram, Slack, Feishu/Lark, WeChat, WeCom, DingTalk를 다룬다. 채널은 자동 시작되고, 일부는 public IP가 없어도 long-polling 또는 WebSocket 방식으로 작업을 받을 수 있다고 설명한다.

이 부분은 데모에서는 잘 안 보이지만 실제 운영에서는 중요하다. 많은 에이전트 도구가 웹 UI 안에서는 그럴듯하게 보이지만, 팀이 실제 일을 던지는 곳은 Slack, Telegram, Lark 같은 메시징 채널이다. 에이전트가 별도 콘솔에 갇혀 있으면 사용 빈도가 낮아진다. 반대로 기존 커뮤니케이션 흐름 안에서 작업을 받고 결과를 돌려주면 자동화가 훨씬 자연스럽다.

다만 여기에도 함정이 있다. 메시징 채널을 열면 권한, 사용자 allowlist, 파일 크기 제한, 내부 인증, CSRF, 세션 기본값 같은 운영 디테일이 따라온다. DeerFlow README가 allowed users, session context, internal auth, file/image limit 같은 항목을 길게 적어둔 이유가 여기에 있다. 에이전트 채널은 “봇 붙이기”가 아니라 운영 경계 설계다.

실무적으로 볼 때 DeerFlow 2.0은 어디에 맞나

DeerFlow를 바로 프로덕션 핵심 자동화에 넣기보다는, 나는 세 가지 용도를 먼저 떠올린다.

1) 장시간 리서치·보고서 생성 실험

공식 사이트의 case study도 deep research report, 영상 기반 조사, 데이터 분석, 팟캐스트 수집 같은 사례를 보여준다. 이런 작업은 한 번의 LLM 응답으로 끝나지 않는다. 검색, 링크 읽기, 요약, 파일 작성, 재검토가 필요하다. DeerFlow의 구조와 가장 잘 맞는 영역이다.

2) 사내 에이전트 워크벤치 프로토타입

팀 내부에서 “이런 작업을 에이전트에게 맡길 수 있을까?”를 검증하려면 모델 API만으로는 부족하다. sandbox, memory, skills, messaging channel, model config를 한 번에 만져봐야 한다. DeerFlow는 이 실험을 빠르게 시작하는 통합 repo 역할을 할 수 있다.

3) 에이전트 런타임 설계 참고자료

실제로 DeerFlow를 쓰지 않더라도 참고할 만한 부분이 있다. setup wizard, doctor command, Docker/Kubernetes sandbox mode, MCP server config, skills directory, IM channels 같은 구성은 에이전트 런타임을 만들 때 반복적으로 필요한 패턴이다.

하지만 위험 신호도 분명하다

오픈소스 SuperAgent harness라는 포지션은 매력적이지만, 동시에 어렵다. 특히 README 기준으로 보면 DeerFlow는 많은 면을 한 번에 다루고 있다. backend, frontend, gateway, sandbox, model providers, MCP, skills, memory, messaging channels까지 범위가 넓다. 이런 프로젝트는 빠르게 유용해질 수 있지만, 유지보수 복잡도도 빨리 올라간다.

실무 도입 전에 봐야 할 체크리스트는 다음과 같다.

- 내가 쓰려는 model provider가 안정적으로 설정되는가

- sandbox mode가 실제 보안 요구사항을 만족하는가

- long-running task 실패 시 재시도·중단·로그 확인이 충분한가

- messaging channel을 켰을 때 사용자 권한과 파일 처리 경계가 명확한가

- skills가 늘어났을 때 버전 관리와 검증 절차가 있는가

- 로컬 개발과 Docker/prod 환경의 설정 차이가 운영 사고를 만들지 않는가

DeerFlow의 장점은 넓은 통합이다. 약점도 같은 곳에서 나온다. 모든 것을 품은 에이전트 워크벤치는, 모든 것의 경계도 같이 책임져야 한다.

검색 의도 관점: DeerFlow는 LangGraph 대체재라기보다 “에이전트 제품 껍데기”다

DeerFlow README는 topics에 langchain, langgraph, multi-agent, superagent 등을 포함한다. 그래서 단순히 LangGraph 대체 프레임워크로 분류하기 쉽다. 하지만 실제 포지션은 조금 다르다.

LangGraph가 그래프 기반 에이전트 로직을 만드는 개발자 프레임워크라면, DeerFlow는 그 위아래에 필요한 제품 껍데기까지 포함하려는 쪽에 가깝다. 웹 UI, gateway, runtime, sandbox, channels, skills, model config, setup flow가 같이 나온다. 즉 “에이전트를 어떻게 작성할 것인가”보다 “에이전트를 어떤 작업 환경으로 제공할 것인가”에 더 관심이 있다.

이 차이를 이해해야 한다. 이미 내부에 견고한 에이전트 런타임이 있는 팀이라면 DeerFlow는 과할 수 있다. 반대로 처음부터 full-stack agent workbench를 만들어야 하는 팀이라면 꽤 많은 설계 힌트를 준다.

결론: DeerFlow 2.0의 메시지는 “에이전트는 앱이 아니라 환경”이라는 것

DeerFlow 2.0에서 가장 중요한 변화는 기능 목록이 아니다. 더 큰 메시지는 이것이다. 에이전트가 쓸 만한 작업자가 되려면, 모델 호출을 감싸는 환경이 필요하다.

그 환경에는 메모리, 파일 시스템, 샌드박스, 툴, 스킬, MCP, 메시징 채널, 설정 검증, 배포 모드가 포함된다. DeerFlow는 이 구성요소를 한데 묶어 “Deep Research 도구”에서 “SuperAgent harness”로 이동하려 한다.

아직은 넓은 범위만큼 검증해야 할 것도 많다. 하지만 방향은 분명하다. 앞으로 에이전트 경쟁은 모델 이름보다 어떤 실행 환경을 제공하느냐, 그리고 그 환경을 얼마나 안전하고 반복 가능하게 운영하느냐로 갈 가능성이 높다.

DeerFlow 2.0은 완성된 정답이라기보다 신호다. Deep Research는 기능이었고, SuperAgent harness는 운영체제에 가깝다. AI 제품을 만드는 팀이라면 이제 프롬프트보다 런타임을 더 진지하게 봐야 한다.

출처