- Published on

agentmemory: AI 코딩 에이전트의 다음 병목은 메모리다

- Authors

- Name

- Kyunghyun Park

- @devkhpark

AI Agent Memory · Coding Agent · MCP · LLM Wiki

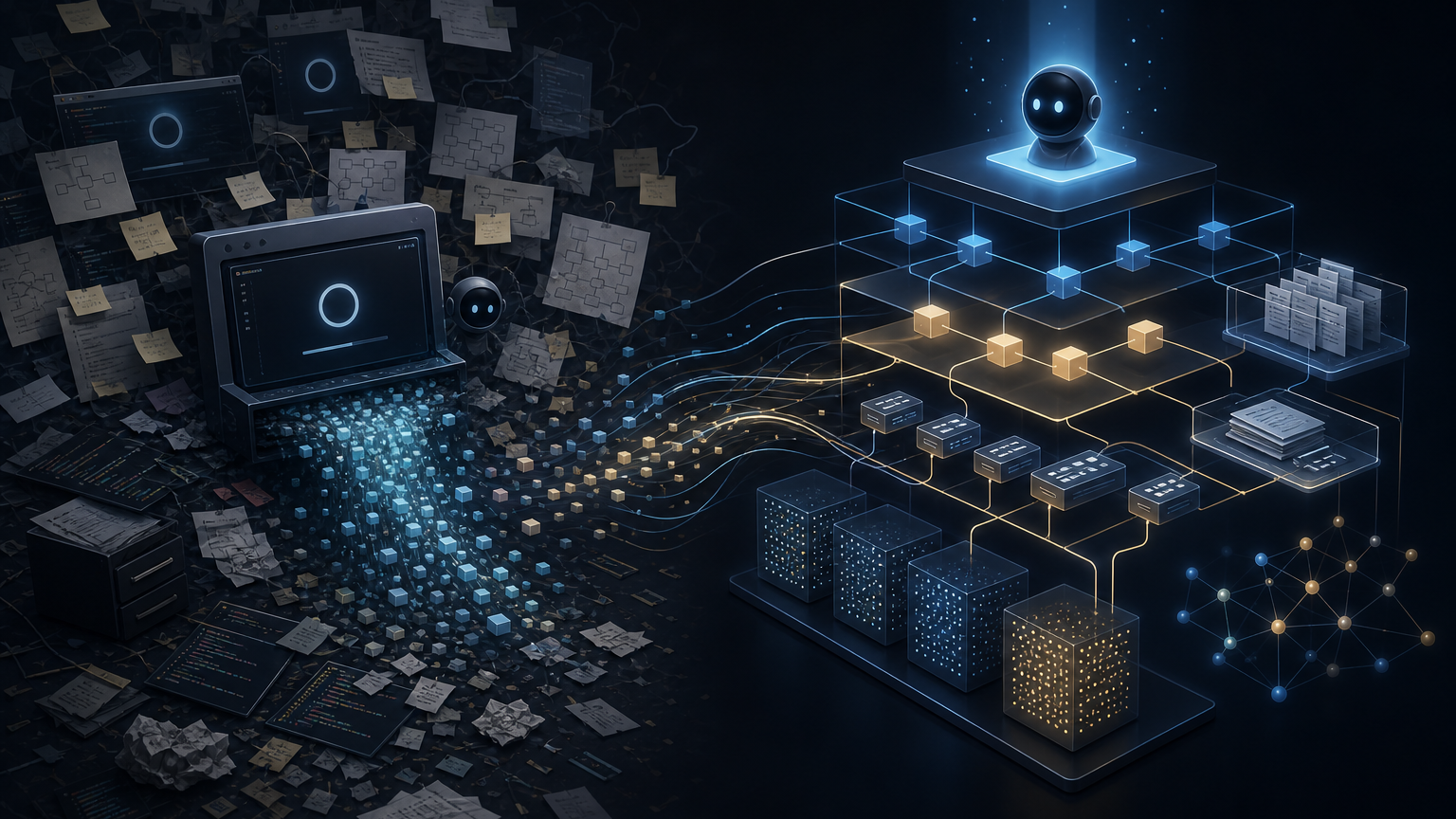

AI 코딩 에이전트의 품질을 가르는 병목이 점점 모델 자체에서 기억을 어떻게 축적하고, 검색하고, 오래된 정보를 어떻게 버리느냐로 이동하고 있다. GitHub Trending에 오른 rohitg00/agentmemory는 이 흐름을 꽤 선명하게 보여준다.

agentmemory의 README는 포지셔닝을 노골적으로 잡는다. “Your coding agent remembers everything. No more re-explaining.” 그리고 Claude Code, Cursor, Gemini CLI, Codex CLI, OpenCode, Cline 같은 MCP/REST/hook 기반 클라이언트가 하나의 메모리 서버를 공유할 수 있다고 설명한다.

이번 글의 관점은 단순하다. agentmemory가 정말 모든 팀의 정답이라는 말은 아니다. 하지만 이 프로젝트가 주목받는 이유는 분명하다. 코딩 에이전트 시장이 “모델이 얼마나 똑똑한가”에서 “팀의 맥락을 얼마나 오래, 안전하게, 재사용 가능하게 보존하는가”로 넘어가고 있기 때문이다.

기준 시점: 이 글은 2026-05-12에 확인한 GitHub Trending 스냅샷, agentmemory README/benchmark 문서, LLM Wiki v2 설계 gist를 바탕으로 썼다. 저장소 수치와 벤치마크 표기는 이후 바뀔 수 있다.

왜 지금 ‘에이전트 메모리’가 다시 중요해졌나

코딩 에이전트를 오래 써본 사람이라면 가장 먼저 체감하는 문제가 있다. 모델은 똑똑해졌는데도 매 세션마다 같은 설명을 다시 해야 한다.

- 이 프로젝트는 왜

jose를 쓰고jsonwebtoken을 안 쓰는지 - 테스트는 어떤 계층에서 돌려야 하는지

- 배포 전에 건드리면 안 되는 파일은 무엇인지

- 지난번에 이미 실패했던 접근은 무엇인지

- 사용자가 선호하는 코드 스타일과 리뷰 기준은 무엇인지

이 정보는 문서, 커밋, 대화 로그, 임시 메모, CLAUDE.md, .cursorrules, issue comment, terminal history에 흩어진다. 문제는 에이전트가 다음 세션에서 이 전체 맥락을 자동으로 복원하지 못한다는 점이다.

그래서 많은 팀이 처음에는 긴 시스템 프롬프트나 프로젝트별 지침 파일을 만든다. 이 방식은 빠르게 효과가 있다. 하지만 금방 한계도 온다. 정적 파일은 오래된 결정을 계속 들고 있고, 너무 길어지면 컨텍스트를 잡아먹고, 어떤 사실이 최신인지 판단하기 어렵다.

agentmemory가 겨냥하는 지점은 바로 이 사이 간극이다. README 기준으로 agentmemory는 에이전트가 한 일을 자동으로 캡처하고, 검색 가능한 기억으로 압축하고, 다음 세션 시작 시 필요한 맥락을 주입하는 쪽에 초점을 둔다. 즉 프롬프트 파일을 더 길게 만드는 것이 아니라, 기억을 별도 운영 계층으로 분리하려는 접근이다.

GitHub Trending 신호: 이건 작은 니치가 아니다

이번 주목의 출발점은 GitHub Trending이다. 2026-05-12 스냅샷에서 rohitg00/agentmemory는 “#1 Persistent memory for AI coding agents based on real-world benchmarks”라는 설명으로 올라왔고, wiki 캡처 기준 stars 4,441, forks 417, stars today 655를 기록했다.

중요한 건 숫자 자체보다 같이 뜬 저장소들의 맥락이다. 같은 스냅샷에는 UI-TARS Desktop, openhuman, React Doctor, Hermes Agent, LLMs-from-scratch 같은 에이전트/개발자 도구/AI 학습 계열 프로젝트가 함께 있었다. 위키의 당일 해석도 13개 저장소 중 11개를 AI/agent/tooling으로 분류했다.

이 조합은 지금 개발자 관심사가 어디에 있는지 보여준다. 사람들은 더 이상 “LLM API 호출 예제”만 찾지 않는다. 실제로 팀 업무에 붙일 수 있는 다음 요소를 찾는다.

- 장기 기억

- 브라우저/데스크톱 조작

- 코드 품질 감시

- 모델 실행/라우팅

- 에이전트 스킬과 워크플로

- 여러 도구가 공유하는 컨텍스트 계층

agentmemory는 이 중에서도 가장 지루하지만 중요한 영역을 건드린다. 에이전트가 매번 처음 보는 사람처럼 굴지 않게 하는 것.

agentmemory의 핵심 설계: MCP 서버 + hook + REST + 공유 기억

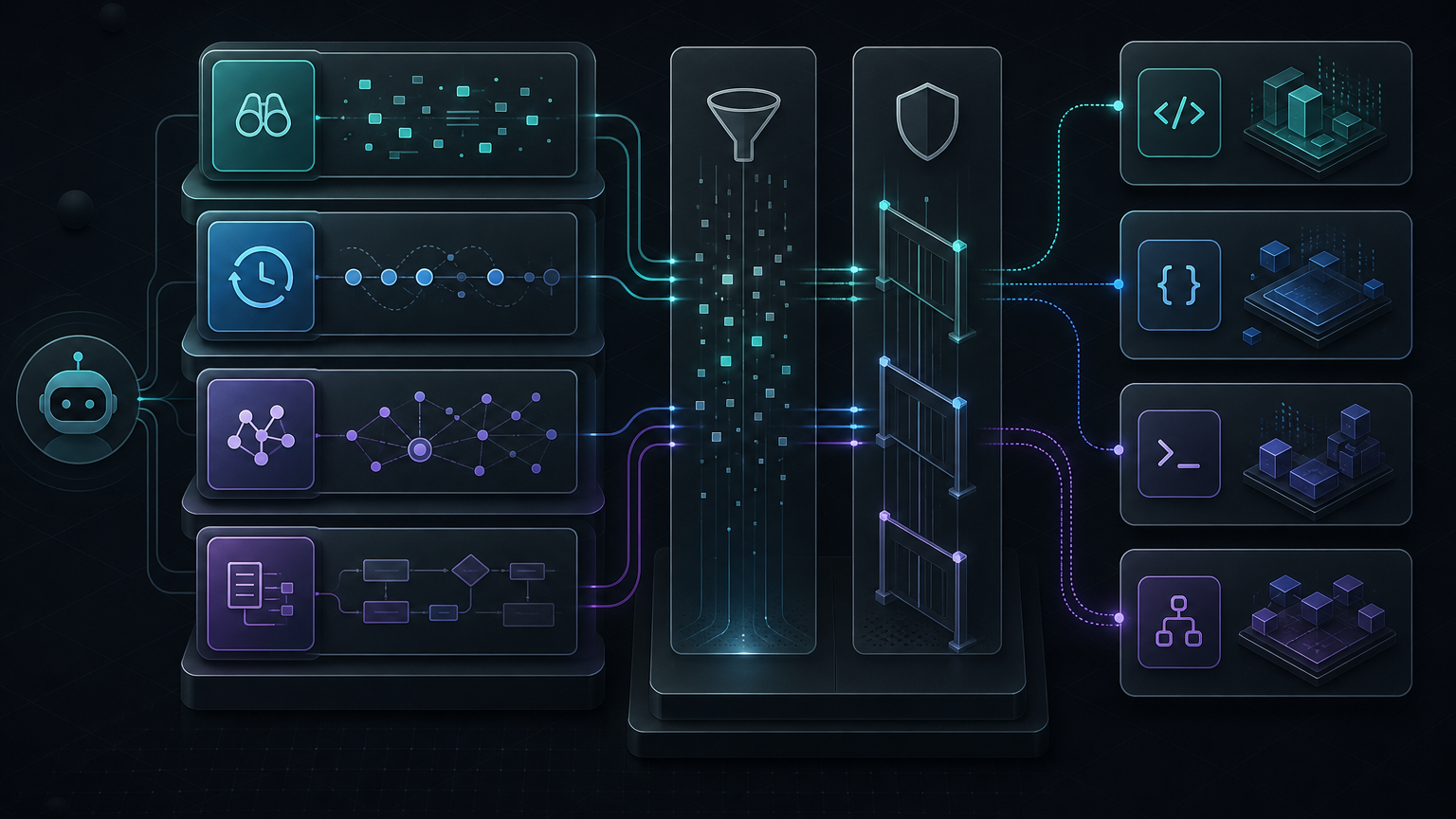

agentmemory README에서 가장 실무적으로 중요한 문장은 “works with any agent that supports hooks, MCP, or REST API”다. 특정 에이전트 런타임 안에 갇힌 기능이 아니라, 여러 클라이언트가 공유할 수 있는 별도 기억 서버로 자신을 설명한다.

이 접근의 장점은 세 가지다.

첫째, 에이전트가 바뀌어도 기억을 버리지 않는다. Claude Code를 쓰다가 Codex CLI, Cursor, Gemini CLI, OpenCode로 일부 작업을 옮겨도, 기억 서버가 공통 계층이면 프로젝트 맥락을 재활용할 수 있다.

둘째, 기억 캡처를 수동 메모 작성에만 맡기지 않는다. README와 benchmark 비교 문서는 agentmemory가 lifecycle hook 기반 자동 캡처를 강조한다고 설명한다. 사람이 “이걸 기억해”라고 말하는 방식만으로는 운영 지식이 충분히 쌓이지 않는다. 실제로 중요한 지식은 실패한 테스트, 수정된 파일, 반복되는 의사결정, 되돌린 접근에서 나온다.

셋째, 기억 검색을 단순 벡터 검색 하나로 보지 않는다. agentmemory는 BM25, vector, graph를 함께 언급한다. 이건 코딩 에이전트 메모리에서 꽤 타당한 선택이다. 코드베이스 지식은 자연어 의미도 중요하지만, 파일명·함수명·패키지명·에러 메시지 같은 정확한 문자열도 매우 중요하기 때문이다.

벤치마크를 읽는 올바른 방법: ‘QA 점수’가 아니라 검색 계층 신호다

agentmemory README는 95.2% retrieval R@5, 98.6% R@10 같은 수치를 전면에 둔다. 근거로 제시된 LongMemEval-S benchmark 문서를 보면, 이 수치는 LongMemEval-S 500개 질문에 대한 retrieval-only 평가다.

문서가 스스로 밝히는 조건도 중요하다.

- Dataset: LongMemEval-S, 500 questions

- 각 질문은 약 48개 세션, 약 115K tokens 맥락

- Metric:

recall_any@K - Embedding model:

all-MiniLM-L6-v2 - LLM judge나 answer generation은 사용하지 않음

그래서 이 수치를 “agentmemory가 장기 기억 QA를 95.2% 해결한다”로 읽으면 과장이다. 더 정확한 해석은 이렇다.

agentmemory는 장기 대화 기억에서 정답이 들어 있을 가능성이 높은 세션을 상위 5개 안에 꽤 잘 끌어올리는 검색 계층을 만들었다고 주장한다.

이 차이는 중요하다. 실무에서 에이전트 메모리는 검색만으로 끝나지 않는다. 검색된 기억이 현재 작업에 맞는지 판단해야 하고, 오래된 정보와 충돌하는지 봐야 하며, 너무 많은 맥락을 주입해서 모델을 헷갈리게 하지 않아야 한다.

그럼에도 이 benchmark가 의미 없는 것은 아니다. 오히려 코딩 에이전트 메모리에서 첫 번째 병목은 검색 recall인 경우가 많다. 필요한 과거 결정을 못 찾으면 그다음 reasoning은 시작도 못 한다. agentmemory가 BM25-only 86.2%에서 BM25+Vector 95.2%로 올라간다고 제시한 것도 이 지점에서 읽어야 한다. 키워드 검색과 semantic retrieval은 경쟁 관계라기보다 보완 관계다.

LLM Wiki v2가 보여주는 더 큰 방향: 기억에도 생명주기가 필요하다

agentmemory README는 자신이 Karpathy의 LLM Wiki 패턴을 확장한 gist에서 출발했다고 설명한다. 그 LLM Wiki v2 gist는 “stop re-deriving, start compiling”이라는 핵심을 유지하면서, 실제 운영에서 빠지는 계층을 추가한다.

특히 중요한 건 memory lifecycle이다.

- confidence scoring: 사실마다 신뢰도를 둔다.

- supersession: 새 정보가 예전 정보를 대체할 수 있어야 한다.

- forgetting: 모든 기억을 영원히 같은 가중치로 보존하지 않는다.

- consolidation tiers: working memory, episodic memory, semantic memory, procedural memory를 구분한다.

이건 단순한 지식관리 취향 문제가 아니다. 코딩 에이전트에서는 오래된 정보가 실제 장애를 만든다. 예를 들어 3개월 전에는 맞았던 배포 절차가 지금은 틀릴 수 있다. 예전 버그 우회책이 지금은 보안 취약점일 수 있다. 특정 라이브러리를 선택한 이유가 새 런타임에서는 더 이상 유효하지 않을 수 있다.

따라서 좋은 에이전트 메모리는 단순히 “많이 기억하는 시스템”이 아니다. 좋은 메모리는 아래 질문에 답해야 한다.

| 질문 | 왜 중요한가 |

|---|---|

| 이 사실은 언제 관측됐나? | 오래된 설정과 최신 설정을 구분해야 한다. |

| 얼마나 자주 강화됐나? | 한 번 나온 추측과 반복 확인된 관행은 다르다. |

| 어떤 출처에서 왔나? | 대화 추정, 코드, 테스트 결과, 공식 문서는 신뢰도가 다르다. |

| 지금 작업에 정말 필요한가? | 불필요한 기억 주입은 컨텍스트 오염을 만든다. |

| 보안상 저장해도 되는가? | 토큰, 고객정보, 내부 URL은 메모리화되면 위험하다. |

agentmemory의 설계 문서와 README는 이 문제를 꽤 의식하고 있다. privacy filtering, audit policy, memory lifecycle, hybrid search를 함께 언급하는 이유도 여기에 있다.

한국 개발팀이 바로 적용할 수 있는 해석

agentmemory를 당장 도입하든 아니든, 이번 흐름에서 가져갈 실무 결론은 분명하다.

1) 프로젝트 지침 파일은 메모리 시스템이 아니다

AGENTS.md, CLAUDE.md, .cursorrules는 여전히 필요하다. 하지만 이것들은 보통 정적 지침에 가깝다. 팀 컨벤션, 빌드 명령, 금지된 작업, 리뷰 기준처럼 안정적인 정보를 담는 데 좋다.

반면 에이전트 메모리는 더 동적이어야 한다. 최근 실패한 접근, 새로 발견한 구조, 특정 테스트의 함정, 사용자 피드백, 반복되는 운영 절차 같은 것은 수시로 바뀐다. 이 둘을 같은 파일에 계속 밀어 넣으면 파일은 곧 길고 낡은 프롬프트 덩어리가 된다.

2) 검색 전략은 벡터 하나로 끝내지 말아야 한다

코딩 맥락에서는 정확한 문자열이 매우 강하다. 에러 메시지, 파일 경로, 함수명, migration 이름, feature flag, 환경변수는 semantic similarity보다 exact match가 잘 맞는 경우가 많다. 반대로 “지난번에 인증 쪽에서 Edge compatibility 때문에 바꾼 결정” 같은 질문은 벡터 검색이나 요약된 semantic memory가 더 유리하다.

그래서 실무적으로는 BM25/FTS + vector + graph/link 기반 검색을 함께 보는 편이 안전하다. agentmemory가 이 조합을 전면에 둔 건 방향이 맞다.

3) 자동 캡처는 편하지만, 저장 정책이 먼저다

hook 기반 자동 캡처는 매력적이다. 하지만 자동으로 저장되는 시스템일수록 정책이 중요하다.

- secret, API key, customer data는 저장 전에 제거되는가?

- 삭제 요청은 감사 가능하게 처리되는가?

- 개인 선호와 프로젝트 사실을 분리하는가?

- 팀 전체 기억과 개인 기억을 섞지 않는가?

- 오래된 기억의 우선순위를 낮추는가?

에이전트 메모리는 생산성 도구이면서 동시에 데이터 보관 시스템이다. 도입 판단은 기능보다 governance를 먼저 봐야 한다.

4) 여러 에이전트를 쓰는 팀일수록 공통 메모리 계층이 필요해진다

요즘 개발팀은 하나의 에이전트만 쓰지 않는다. IDE에는 Cursor나 Copilot이 있고, 터미널에는 Claude Code나 Codex CLI가 있고, 브라우저 자동화에는 MCP 도구가 붙고, 배포/문서화는 별도 agent가 맡을 수 있다.

이때 각 도구가 자기 기억만 들고 있으면 팀 지식은 다시 조각난다. agentmemory의 “one server, memories shared across all of them” 포지션이 중요한 이유가 여기에 있다. 앞으로 에이전트 스택에서 메모리는 개별 앱 기능보다 공통 인프라에 가까워질 가능성이 높다.

SEO 관점의 키워드도 바뀐다: RAG보다 agent memory다

한국어 검색 시장에서는 아직 “AI 에이전트”, “MCP”, “코딩 에이전트”, “RAG”, “Claude Code”, “Cursor” 같은 키워드가 따로 움직인다. 하지만 실무 문제는 점점 하나로 합쳐진다.

개발팀이 실제로 찾는 질문은 이런 쪽이다.

- AI 코딩 에이전트가 프로젝트 맥락을 기억하게 하려면?

- Claude Code와 Codex CLI가 같은 메모리를 쓰게 할 수 있나?

- 에이전트 메모리는 벡터 DB만 있으면 충분한가?

- 장기 기억을 저장할 때 보안 문제는 어떻게 막나?

CLAUDE.md와 agent memory는 무엇이 다른가?

이 검색 의도에 답하려면 “RAG 구축법”만으로는 부족하다. RAG는 보통 문서 검색 문제로 시작하지만, agent memory는 행동·결정·실패·선호·절차를 시간축 위에서 관리하는 문제에 가깝다.

한 줄 결론

agentmemory가 보여주는 핵심은 “새로운 메모리 라이브러리가 나왔다”가 아니다. 코딩 에이전트가 실무 도구가 될수록, 모델 성능 다음의 경쟁축은 장기 기억을 운영 가능한 인프라로 만드는 능력이 된다는 점이다.

한국 개발팀이 지금 봐야 할 포인트도 명확하다. 에이전트 프로젝트를 시작할 때 프롬프트, 모델, MCP 서버만 고르지 말고, 처음부터 무엇을 기억할지, 어디에 저장할지, 어떻게 검색할지, 언제 잊을지, 어떤 정보를 절대 저장하지 않을지를 설계해야 한다.

그 설계가 없으면 에이전트는 계속 똑똑하지만 기억력 나쁜 신입처럼 행동한다. 반대로 잘 설계된 메모리 계층이 붙으면, 에이전트는 매번 새로 시작하는 도구가 아니라 팀의 작업 맥락을 축적하는 운영 파트너에 가까워진다.

참고한 주요 출처

- GitHub Trending snapshot, rohitg00/agentmemory, 2026-05-12 확인.

- rohitg00/agentmemory README, Persistent memory for AI coding agents.

- rohitg00/agentmemory benchmark, LongMemEval-S Benchmark Results.

- rohitg00/agentmemory benchmark, AI Agent Memory: Benchmark Comparison.

- Rohit Agarwal, LLM Wiki v2 gist.